교육 세션

교육 세션

인사이트는 총 10회의 교육세션(OT 포함)을 통해 신입 기수의 소프트랜딩을 도모하고,

학회원들의 체계적인 데이터 분석 및 모델링을 위한 기초를 다지고 있습니다.

교육 세션 [파이썬]

교육 세션 [파이썬]

학기 초에는 Github의 사용법과 Python을 학습합니다.

Pandas를 위주로 Python의 기초부터 심화까지, 그리고 EDA에 필요한 데이터 전처리 및 시각화를 3번의 세션에 걸쳐 학습합니다.

Session 0 (OT). Jupyter, Github, VScode

본 세션은 본격적인 교육 세션 진행에 앞선 사전 학습 과정에 해당합니다.

Jupyter Notebook과 VScode를 설치하고 파이썬 개발 환경 초기 설정을 진행하였습니다.

또한, 과제 제출 및 포트폴리오 관리를 위한 Github 활용 방법에 대해 학습하였습니다.

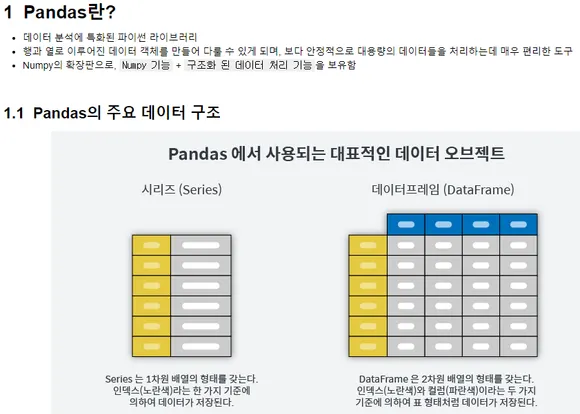

Session 1. Pandas

본 세션에서는 기본적인 파이썬 문법을 복습하고, Pandas 문법을 실제 데이터에 적용해 보았습니다.

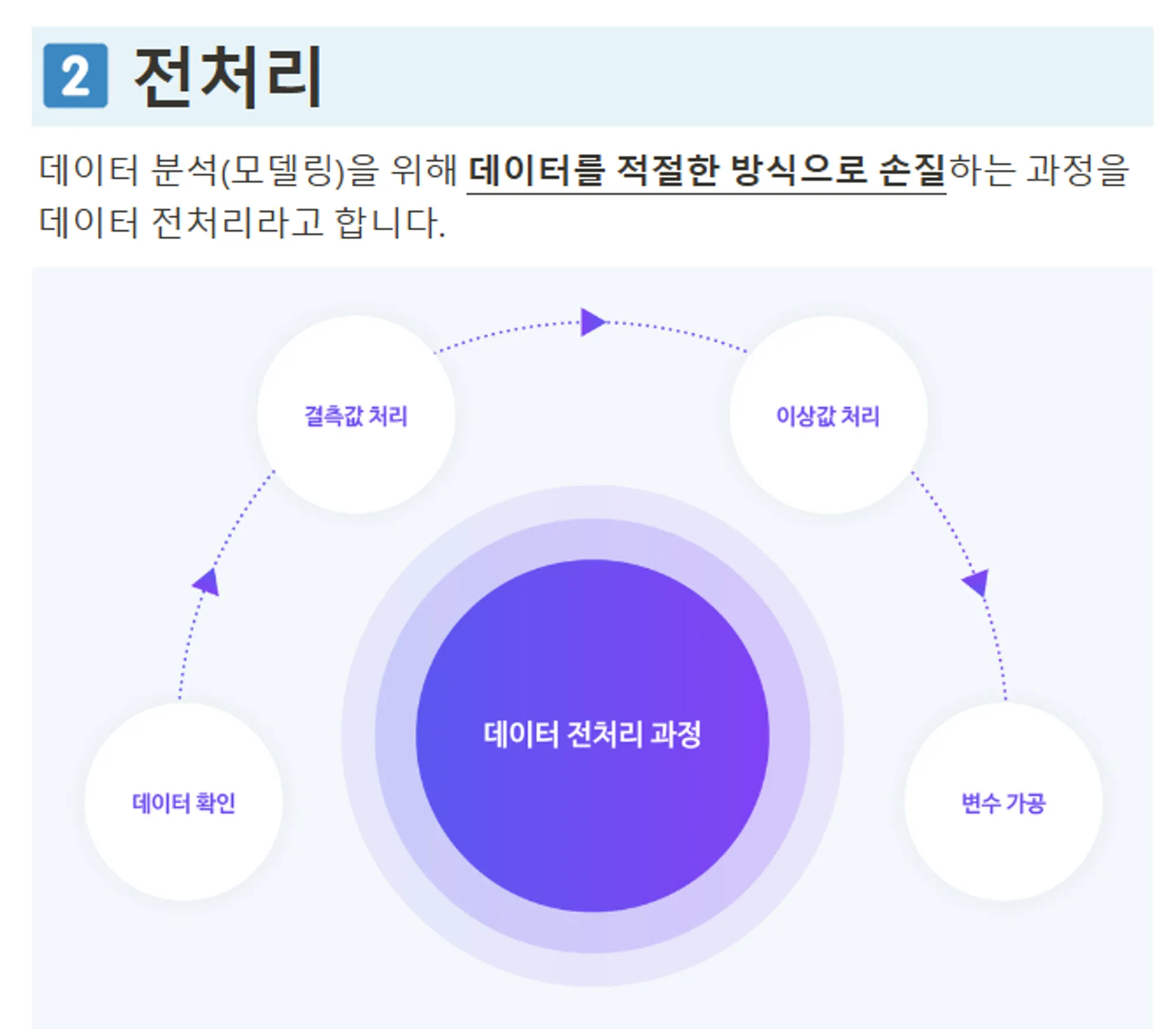

Session 2. EDA & 전처리

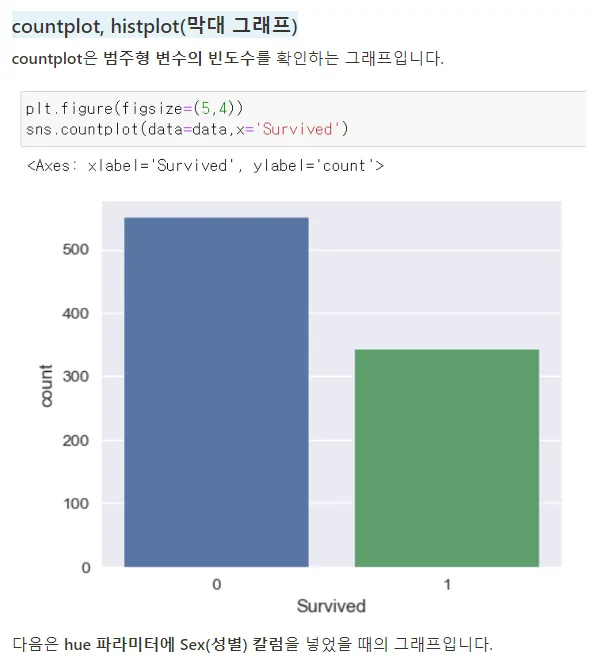

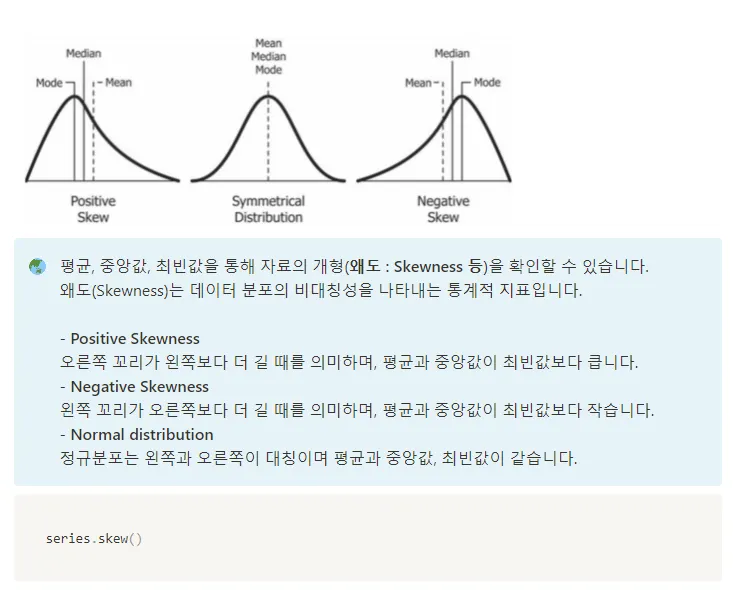

본 세션에서는 데이터를 분석하고 이해하기 위한 EDA와 전처리 과정에 대해 알아보았습니다. 또한 데이터를 읽는 방식과 시각화의 기초적인 내용을 학습하고, EDA의 대상과 종류에 따른 EDA 유형을 파악하였습니다. 모델링을 위해 데이터를 손질하는 전치리 과정을 이해하고, 파이썬을 통해 전처리와 시각화 과정을 실습하였습니다.

교육 세션 [통계]

교육 세션 [통계]

파이썬 교육 세션 이후, 총 4회의 통계 세션(통계, 회귀, 분류)을 통해 데이터 분석의 기반이

되는 기초적인 통계 개념과 머신러닝(회귀, 분류)의 이론적 기반을 학습했습니다.

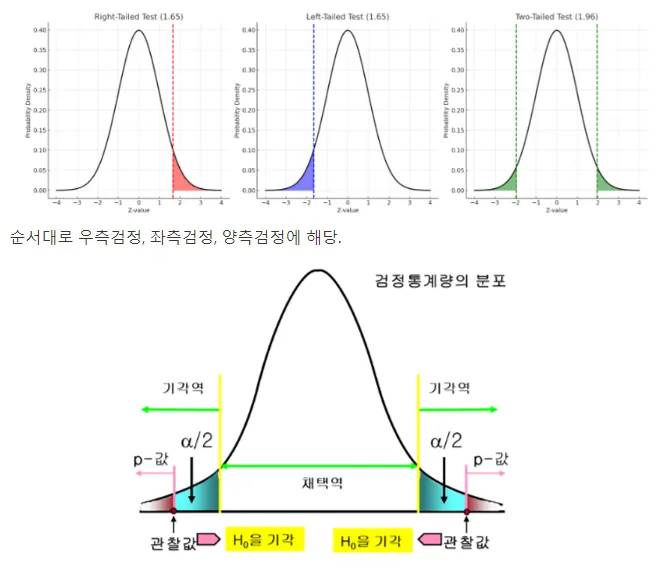

Session 3. 통계

본 세션에서는 기술 통계와 추리 통계, 다양한 분포들과 가설 검정의 절차 및 해석 등 통계와 관련된 다양한 이론적 기반에 대해 학습했습니다.

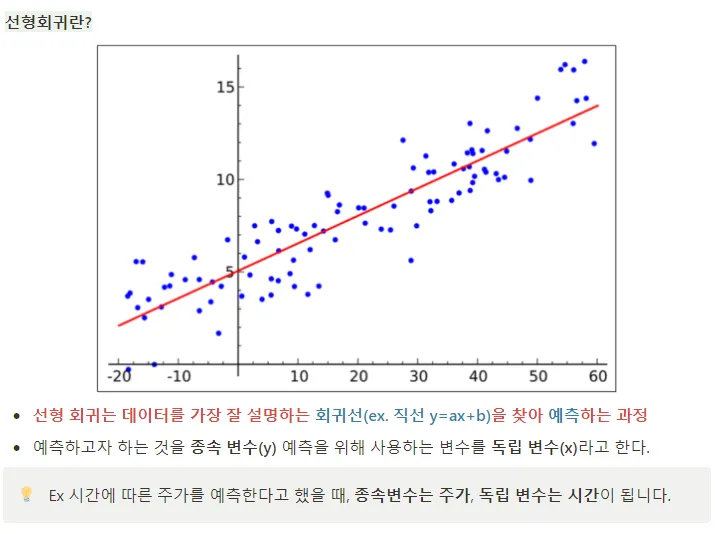

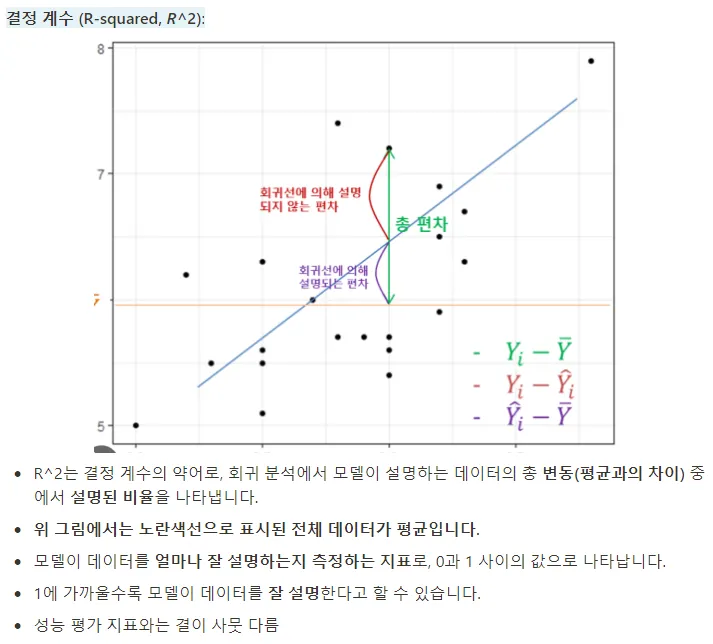

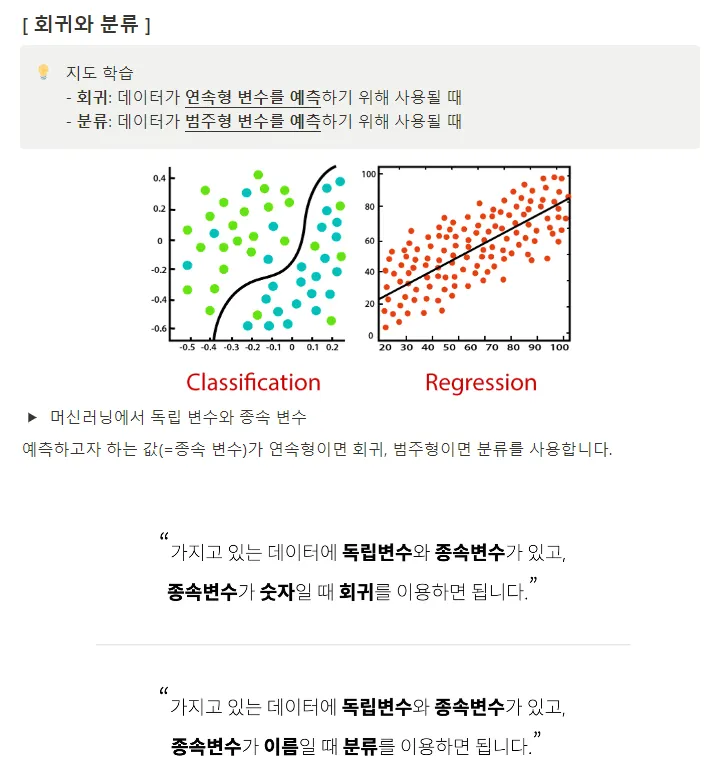

Session 4. 회귀 기초

본 세션에서는 단순 선형 회귀, 다중 선형 회귀의 이론적 기반에 대해 학습하고 실습해보는 시간을 가졌습니다.

Session 5. 회귀 심화

본 세션에서는 다중 선형 회귀의 기본 가정을 검정해 보고 회귀 분석의 평가 방법에 대해 알아보았습니다. 그리고 비선형 회귀 모델을 학습한 뒤 실제 데이터에 적용해 보았습니다.

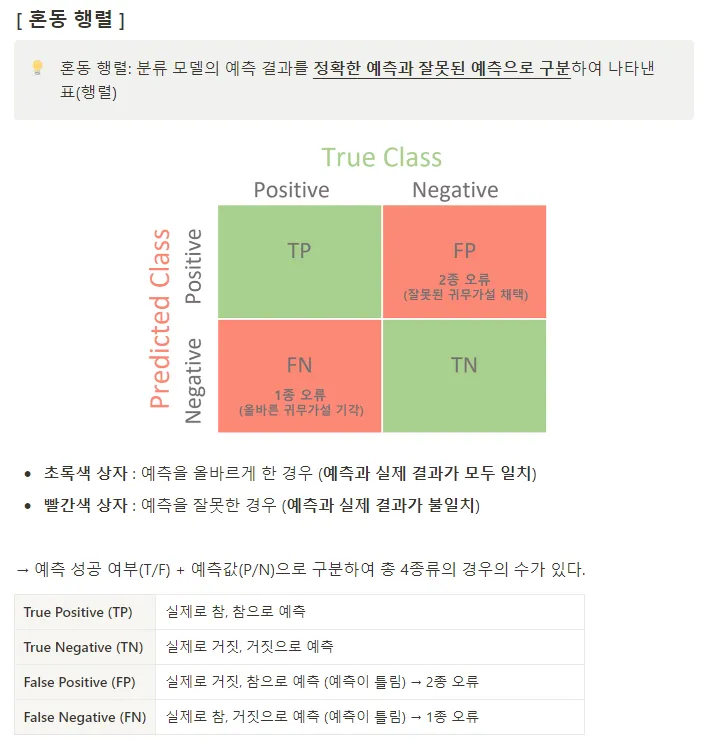

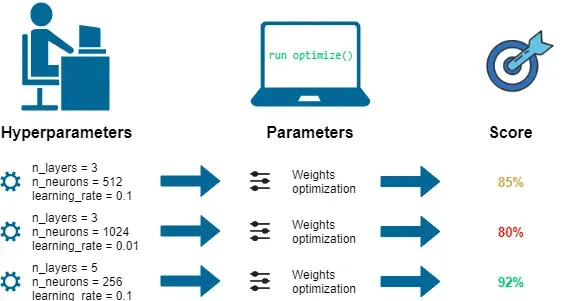

Session 6. 분류

분류의 개념, 종류, 평가 지표에 대해 이해하고 하이퍼파라미터 최적화를 학습했습니다. 그리고 코드를 통해 분류 모델을 구현하고 평가해 보았습니다.

어떤 하이퍼파라미터(Hyperparameters)를 설정하느냐에 따라 모델 성능(Score)가 달라진다.

Session 7. 군집화

군집화의 목표와 특징을 살펴보고 계층적 군집화와 비계층적 군집화의 구분에 대해 학습하였습니다.

계층적 군집화와 비계층적 군집화의 개념과 분석 방법에 대해 구체적으로 살펴보고 각 군집화에 속하는 군집화 방법론을 공부했습니다.

계층적 군집화 | 비계층적 군집화 | |

방법론 | 응집법, 분할법 | K-means, GMM, DBSCAN |

장점 | 데이터가 수의 적은 경우 안정적으로 사용 | 계속적으로 군집을 재구성&할당

데이터의 수가 많을 경우 유용 |

단점 | 한 번 형성된 군집은 다시 판별하지 않음 | 초기 군집의 영향을 크게 받아 불안정한 군집을 제공할 가능성 |

군집화 알고리즘의 평가 방법에 대해 알아보았습니다. 외부평가는 이미 정해진 정답을 기준으로 군집화 알고리즘의 정확도를 측정하는 방식으로, 알고리즘의 성능을 검증하는 데 사용되는 반면, 내부평가는 정답 없이 군집 내 데이터의 응집성과 군집 간의 분리도를 평가하는 방식으로, 주로 Dunn Index나 Silhouette 계수와 같은 지표를 통해 이뤄진다는 점을 살펴보았습니다.

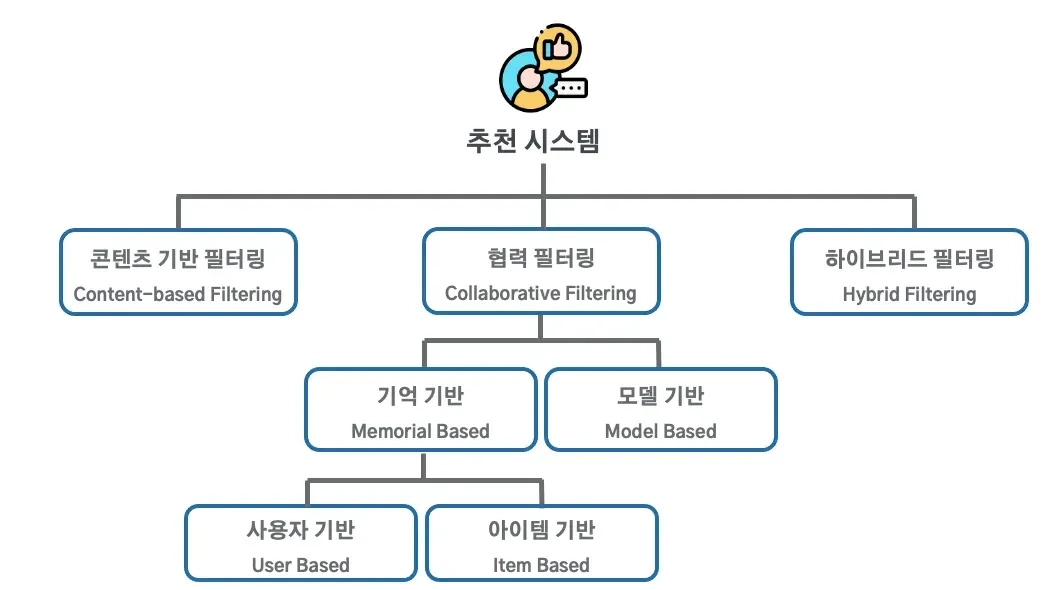

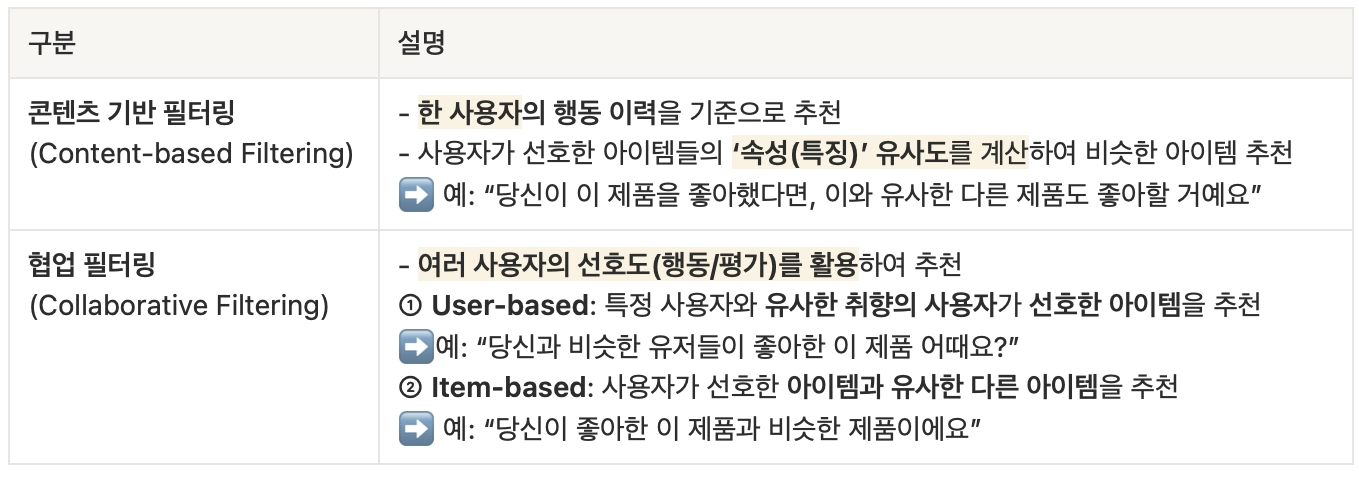

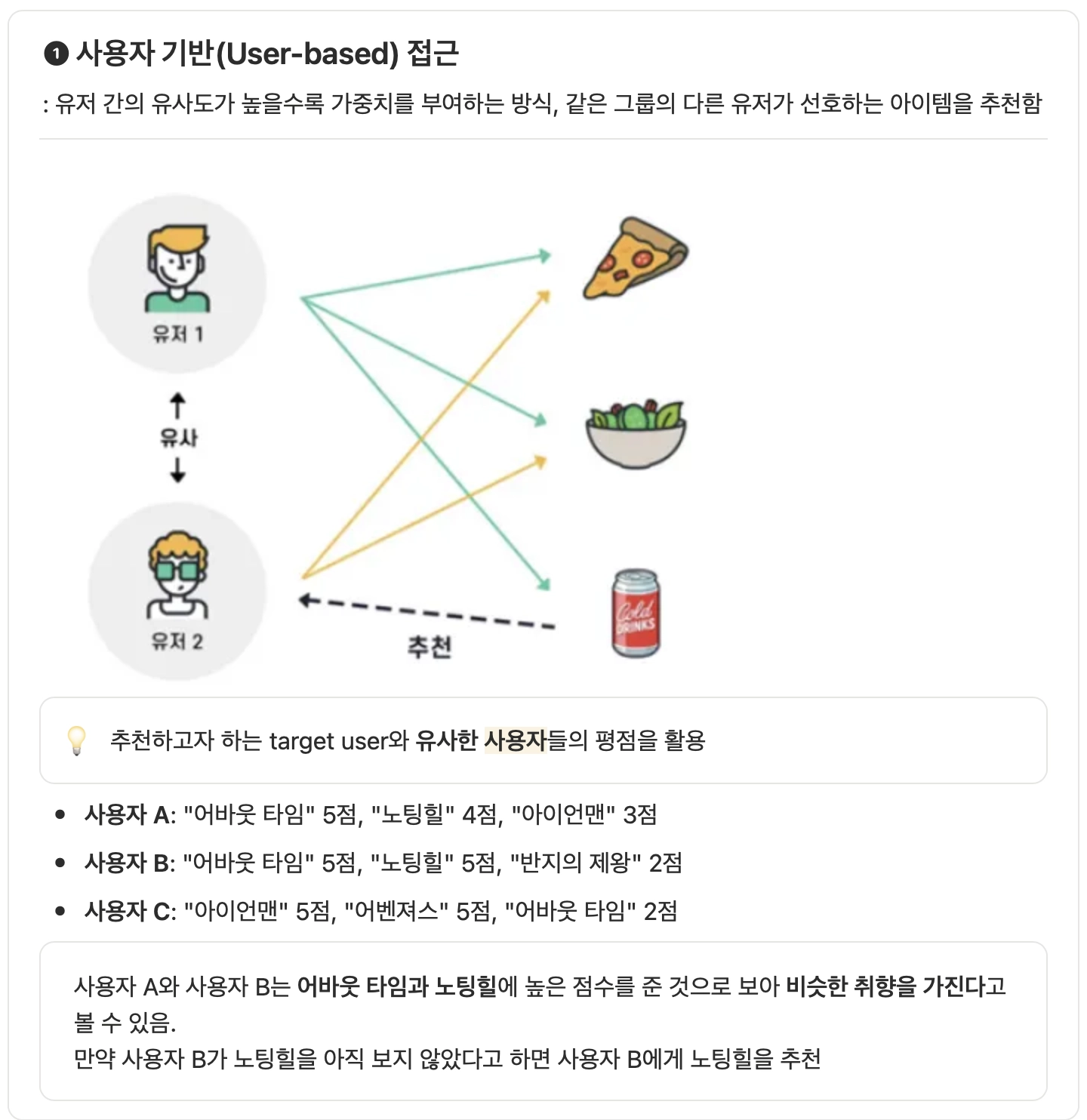

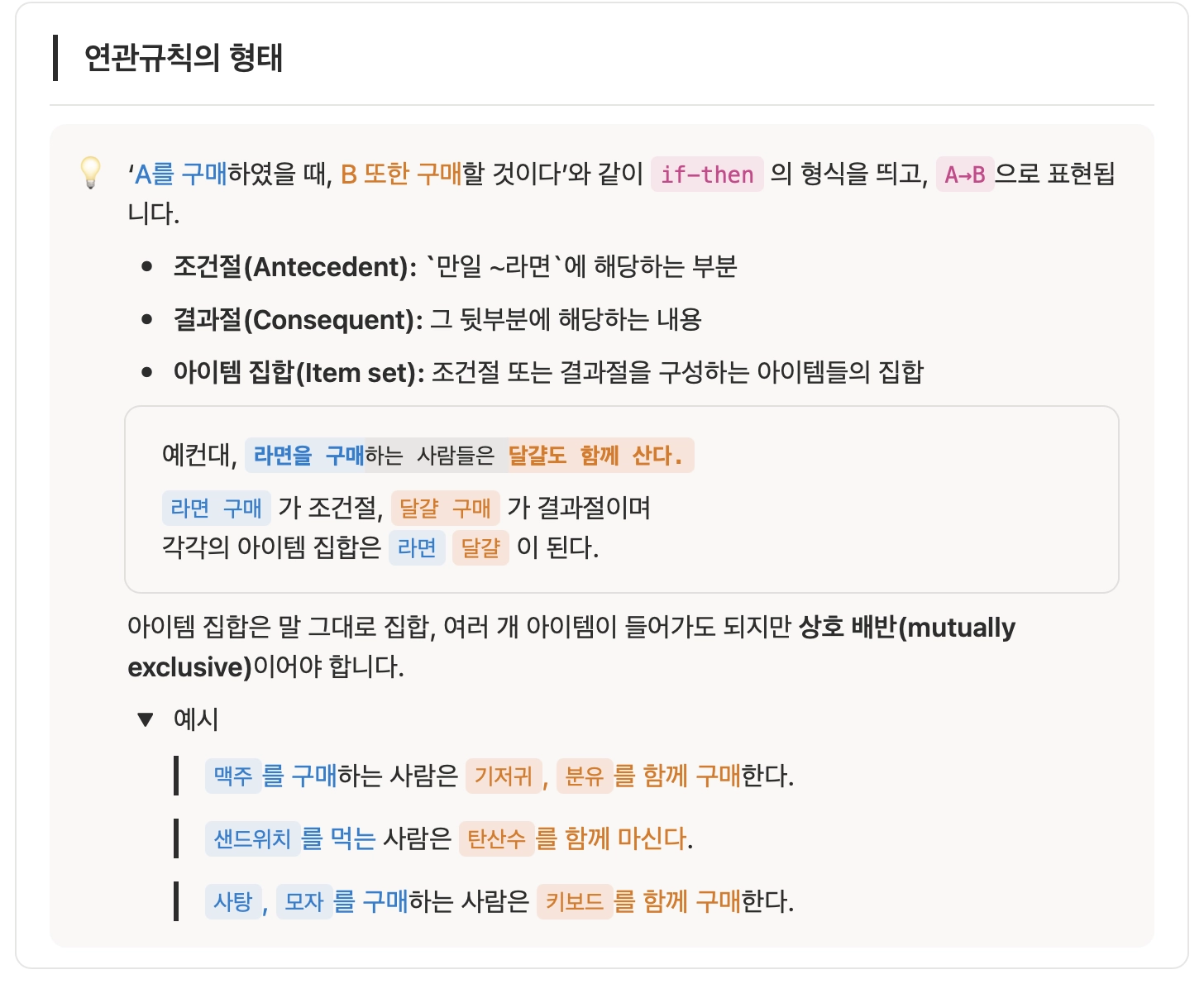

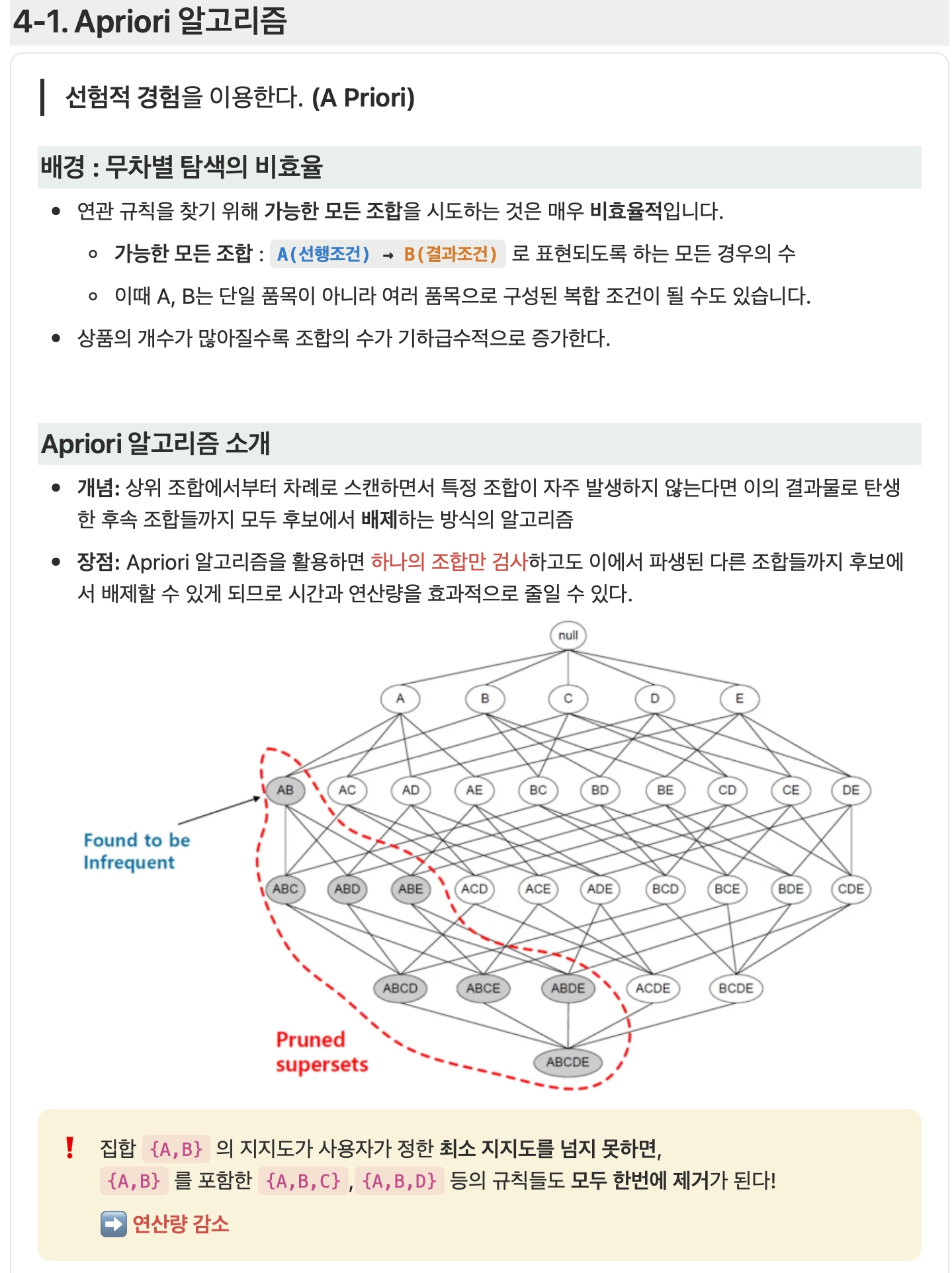

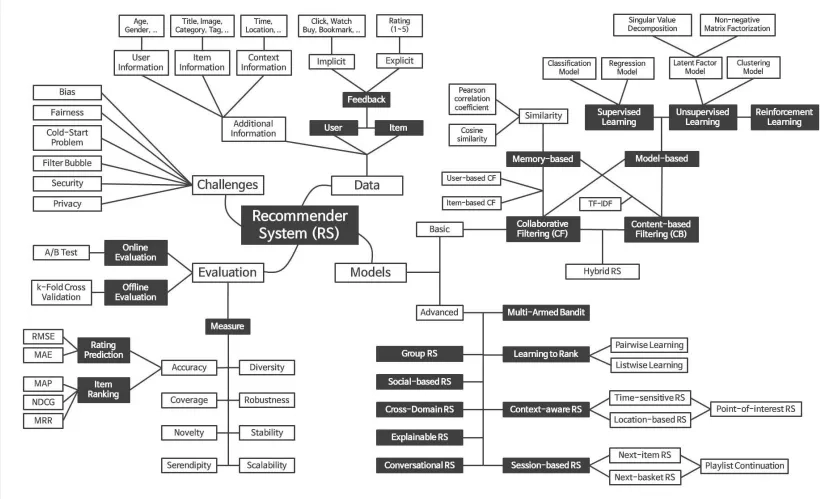

Session 8. 추천 시스템 + 연관 분석 기초

추천 시스템의 개념과 분류를 학습하며 콘텐츠 기반 필터링과 모델 기반 협업 필터링의 개념을 이해하고, Python 코드로 구현하는 방법을 익혔습니다.

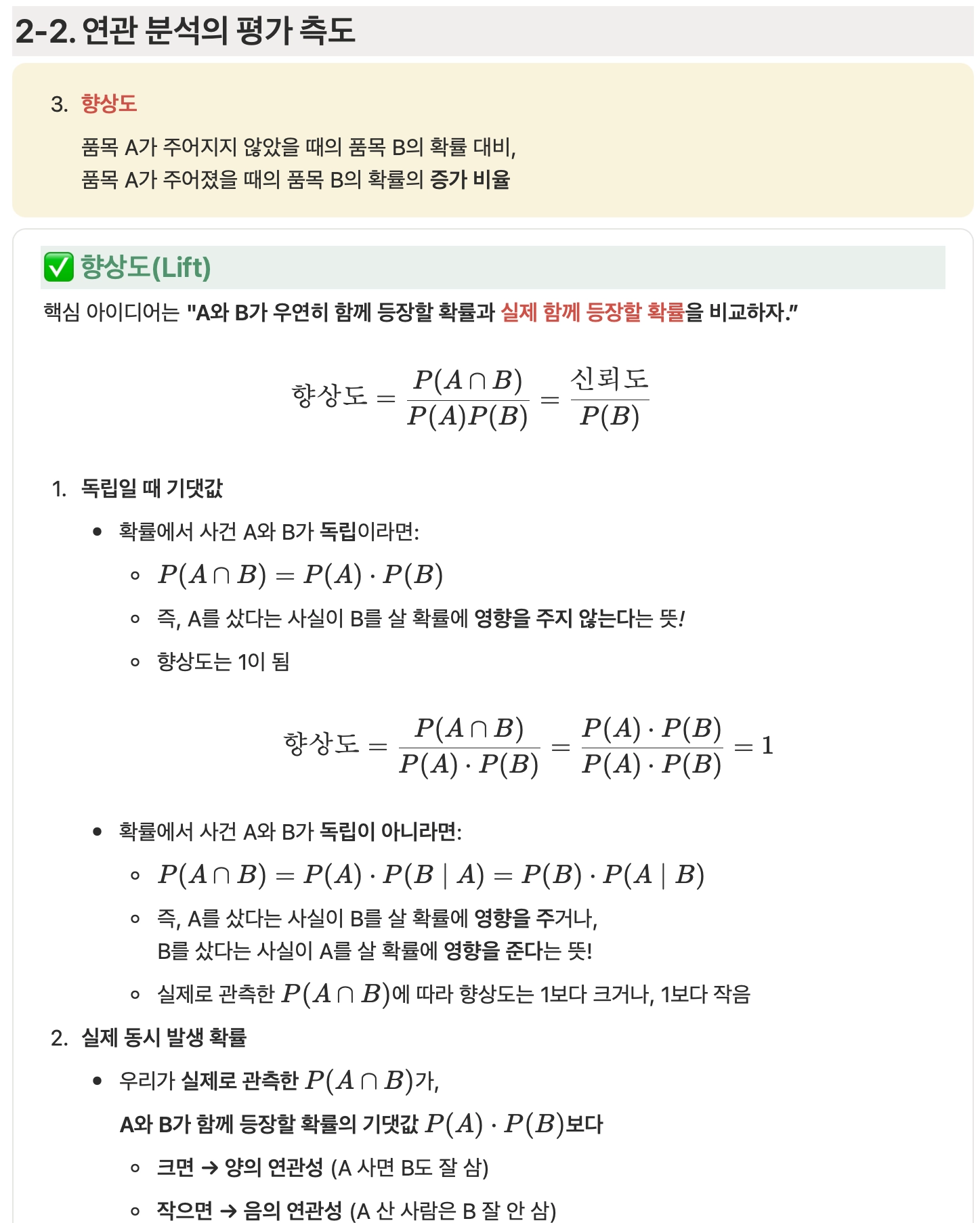

지지도, 신뢰도, 향상도의 개념을 이해하고 실제 전략 수립에 어떤 방식으로 활용 가능한지 알 수 있습니다. Apriori / FP Growth 알고리즘 프로세스를 이해하고, Python 코드로 구현하는 방법을 익힐 수 있었습니다.

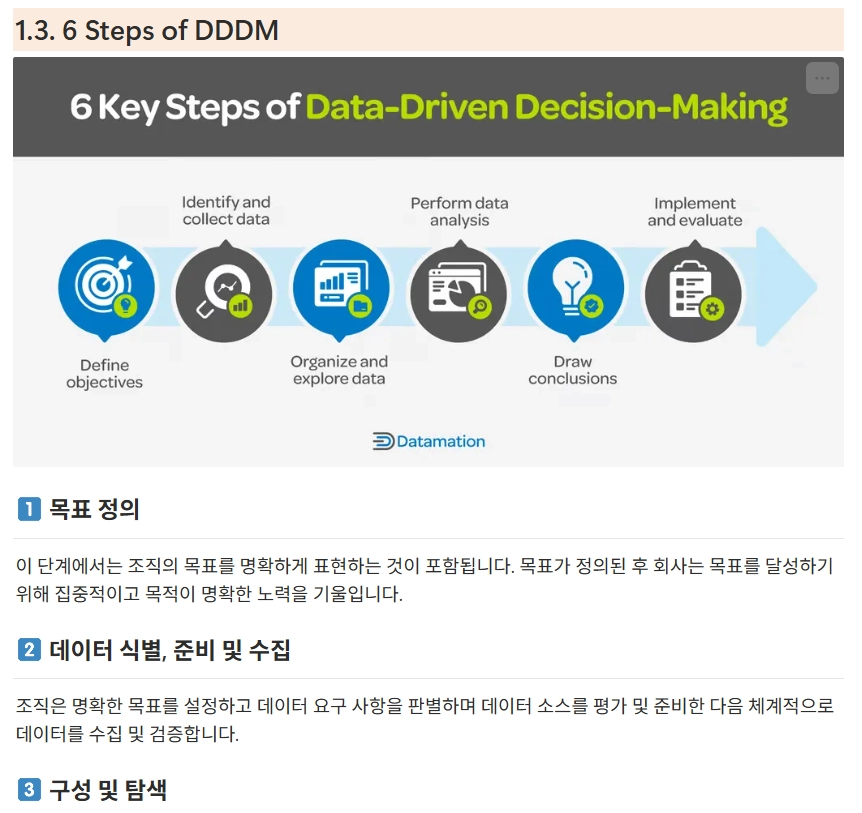

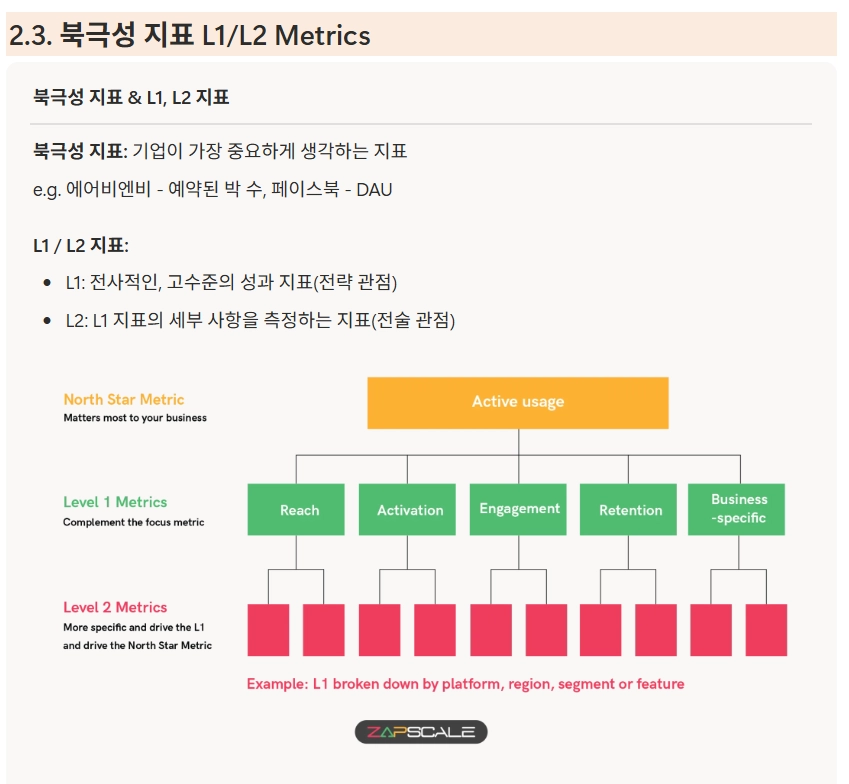

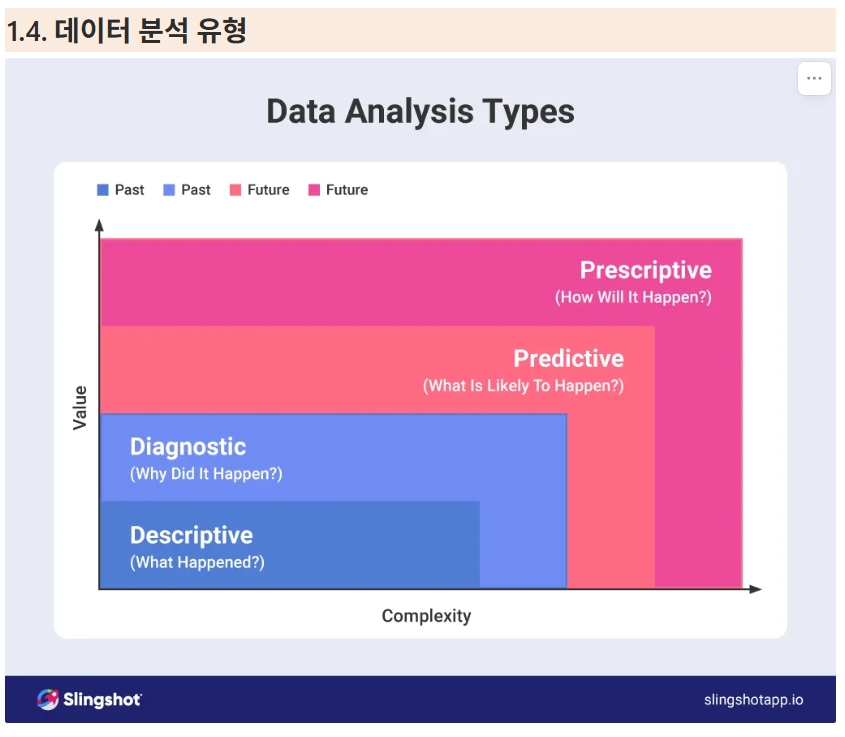

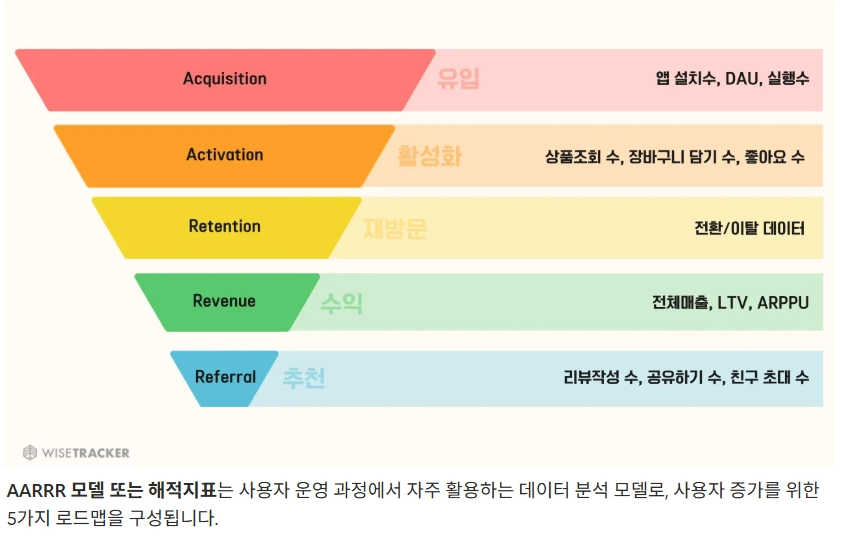

Session 9. 데이터로 보는 비즈니스 상황

데이터를 통해 비즈니스 상황을 이해하는 것을 목표로 하였습니다. Data-Driven Decision Making에 대해 이해하며, 실습을 통해 AARRR 프레임워크를 사용해 보았습니다.

심화 세션

심화 세션

교육 세션을 마친 후에는 총 9회의 심화 세션을 진행했습니다.

데이터 사이언스 심화 주제 중 관심 분야에 따라 팀을 구성하였고, 각 팀은 학습 자료와 실습 과제를 제작하여 주 2회 정규 세션을 진행했습니다.

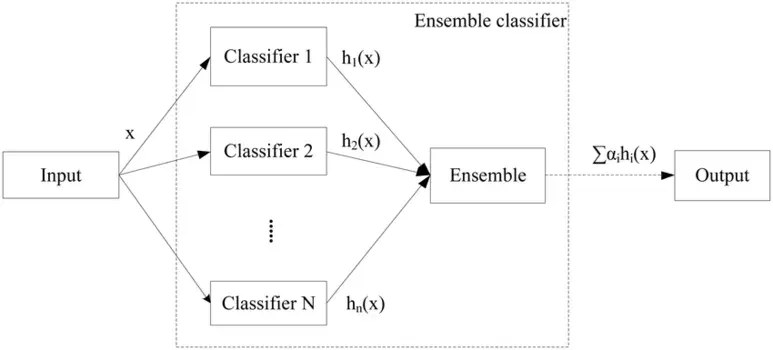

Session 1. 앙상블&AI 기초

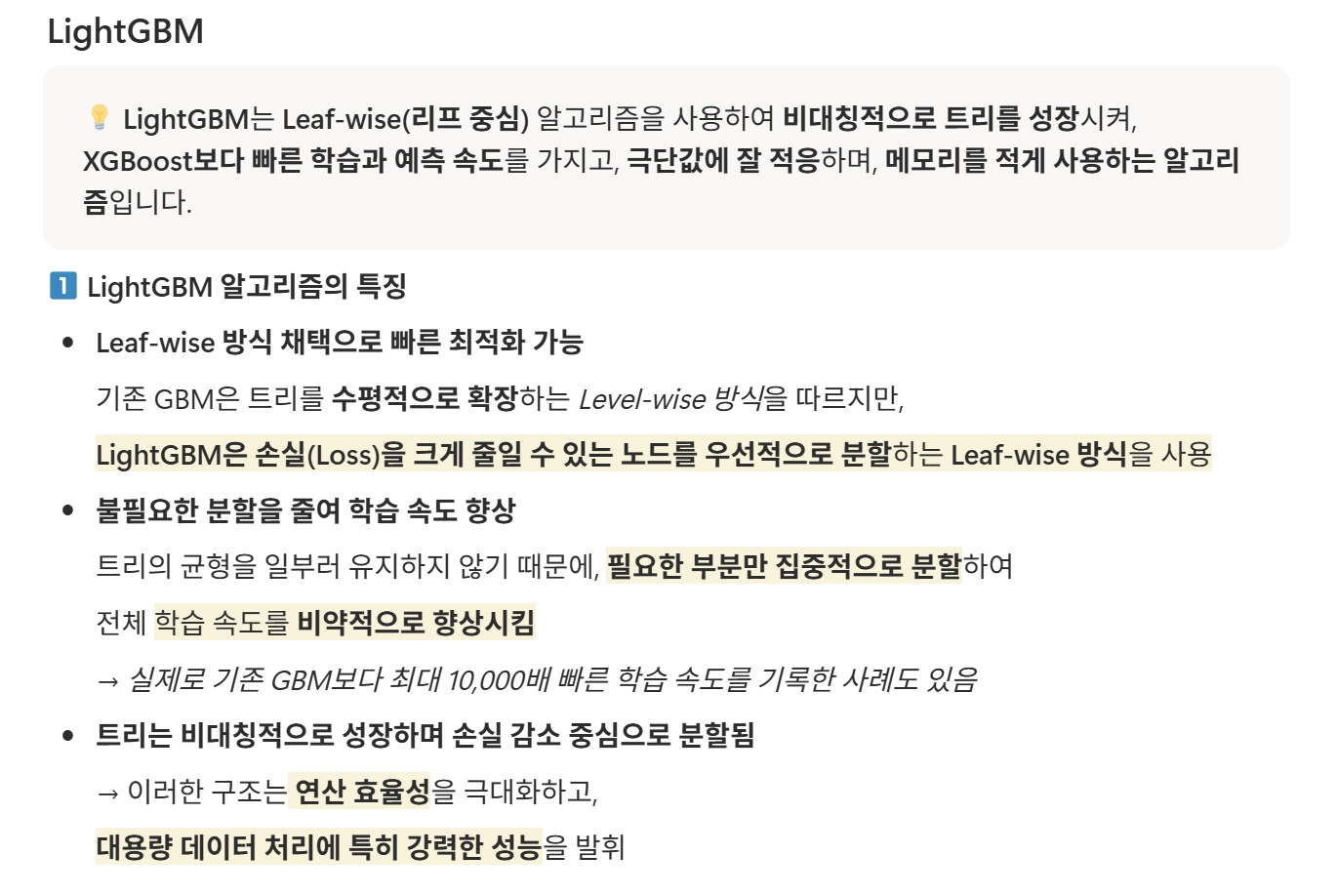

본 세션에서는 여러 개의 개별 분류 모델들을 결합해 하나의 분류 모델보다 더 좋은 성능을 내는 앙상블에 대해 공부했습니다. 종류에 따라 보팅(Voting), 배깅(Bagging), 부스팅(Boosting), 스태킹(Stacking)을 구분하였고, Random Forest, XGBoost, LightGBM 등의 모델들에 대해 알아보았습니다.

앙상블 구조도

랜덤 포레스트의 프로세스

LightGBM 알고리즘 소개

스태킹 알고리즘을 알아보고, K 폴드 교차 검증을 통해 학습과 검증을 반복적으로 수행하는 법을 알아보았습니다.

스태킹 알고리즘

K 폴드 교차검증

앙상블을 포함한 복잡한 모델의 구조적인 한계인 블랙박스 문제와, 이를 해결하기 위한 LIME 알고리즘에 대해 알아보았습니다.

LIME 알고리즘을 통한 블랙박스 해석 프로세스

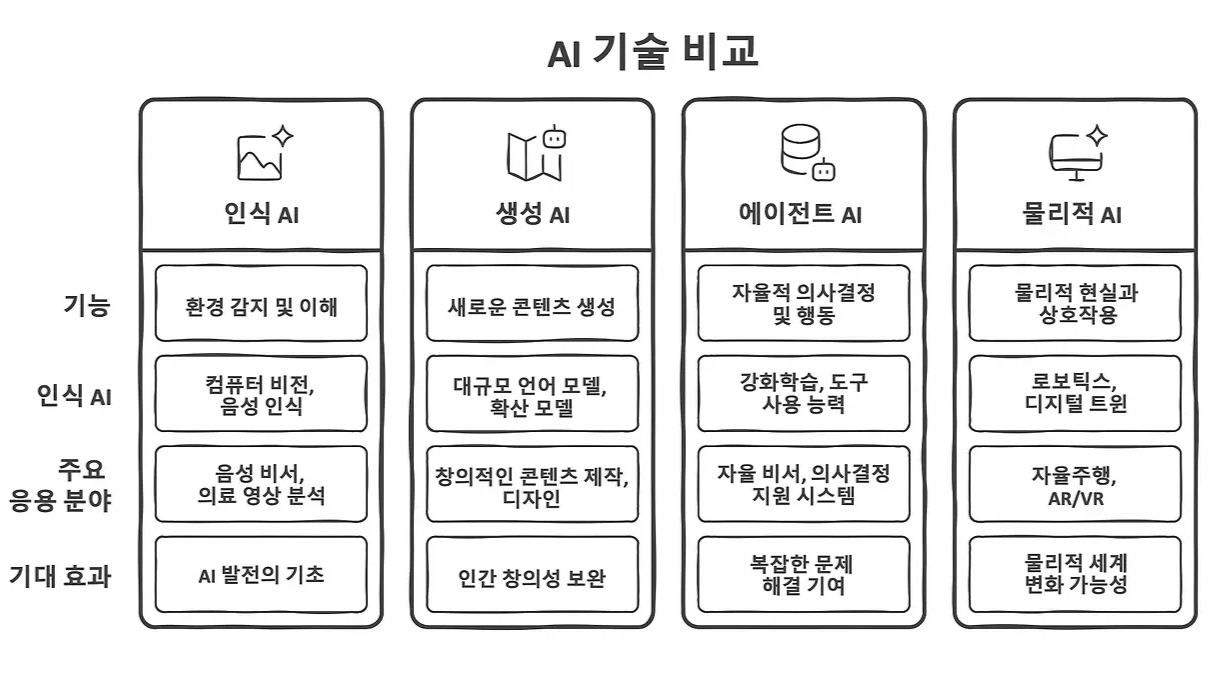

데이터에서 스스로 특징을 추출하는 딥러닝의 핵심 원리를 바탕으로, CNN과 RNN/Transformer 기술이 발전해 온 역사적 과정을 학습했습니다. 특히 BERT와 GPT로 대표되는 언어 모델의 진화에서 나아가, 추론과 행동까지 수행하는 Agent AI와 멀티모달 기술 등 최신 AI 생태계의 전반적인 흐름을 익혔습니다.

항목 | 머신러닝 (Machine Learning) | 딥러닝 (Deep Learning) |

포함 관계 | 인공지능의 한 분야 | 머신러닝의 하위 분야 |

핵심 기술 | 다양한 알고리즘 (의사결정 나무, SVM, K-NN 등) | 심층 신경망 (Deep Neural Network) |

특징 추출 | 사람이 직접 특징을 정의하고 추출 (수동) | 데이터에서 특징을 스스로 학습하고 추출 (자동) |

데이터 양 | 상대적으로 적은 데이터로도 학습 가능 | 대량의 데이터가 필요하며, 많을수록 성능 향상 |

성능 곡선 | 데이터가 적을 때 효율적 | 데이터가 많을수록 높은 성능 발휘 |

주요 활용 | 수치 예측, 분류(단순 패턴), 스팸 메일 분류 등 | 이미지·음성·자연어 처리, 얼굴 인식, 음성 비서 등 |

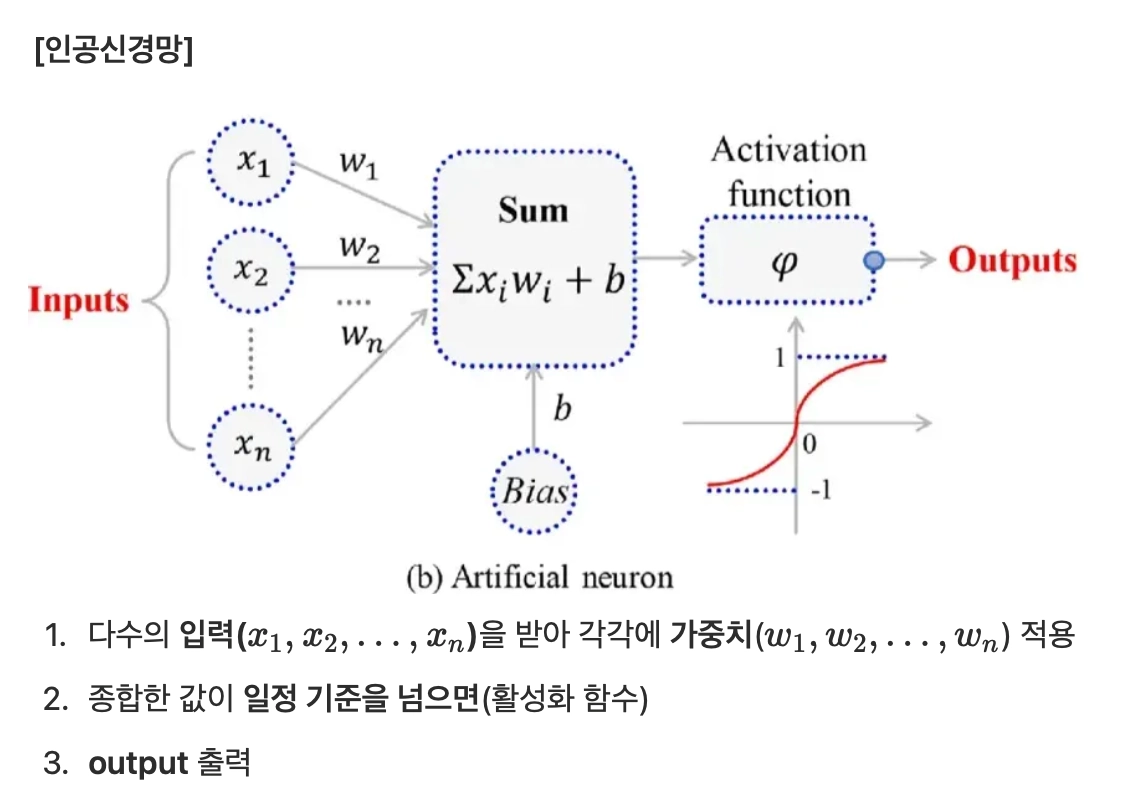

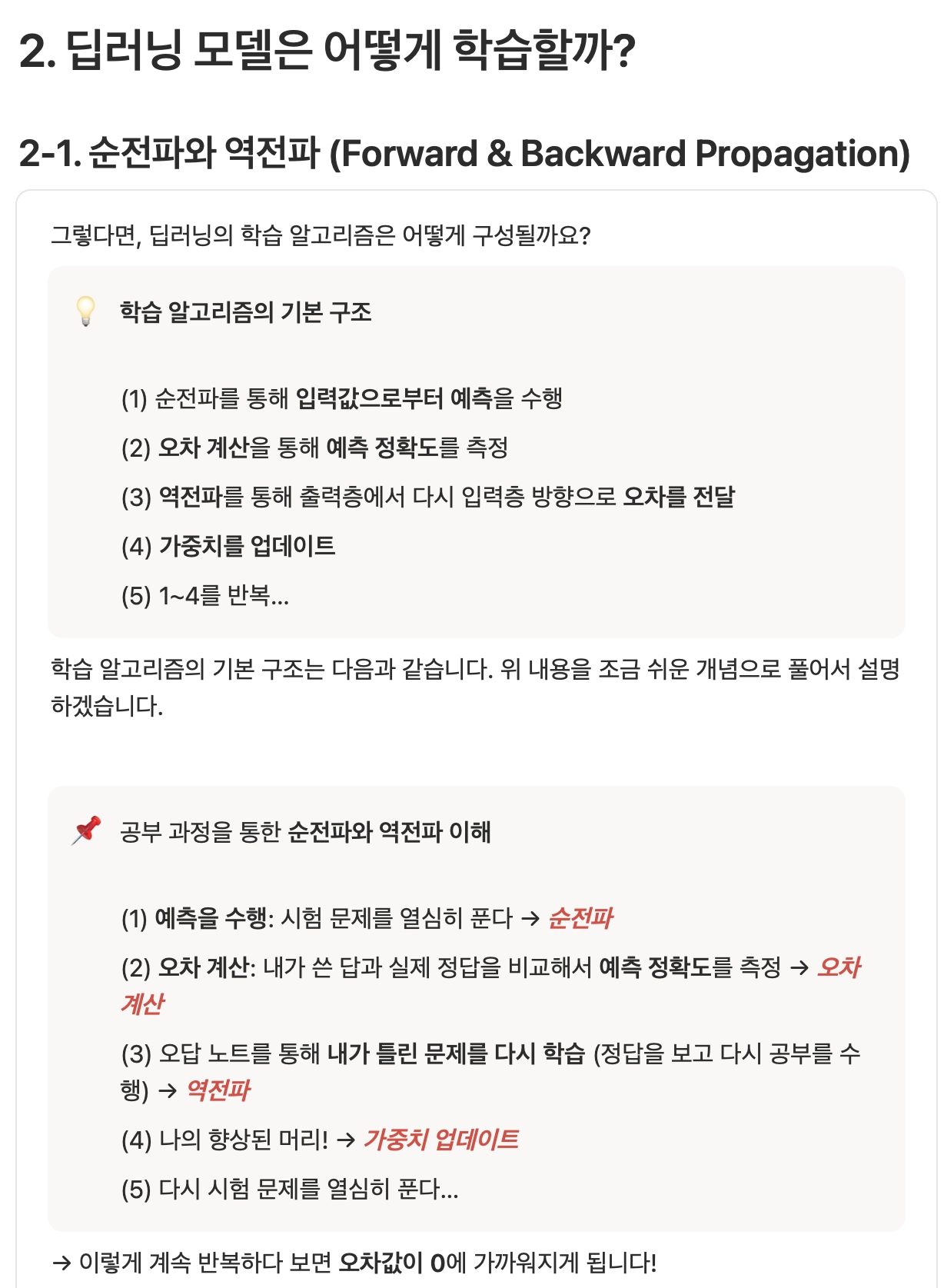

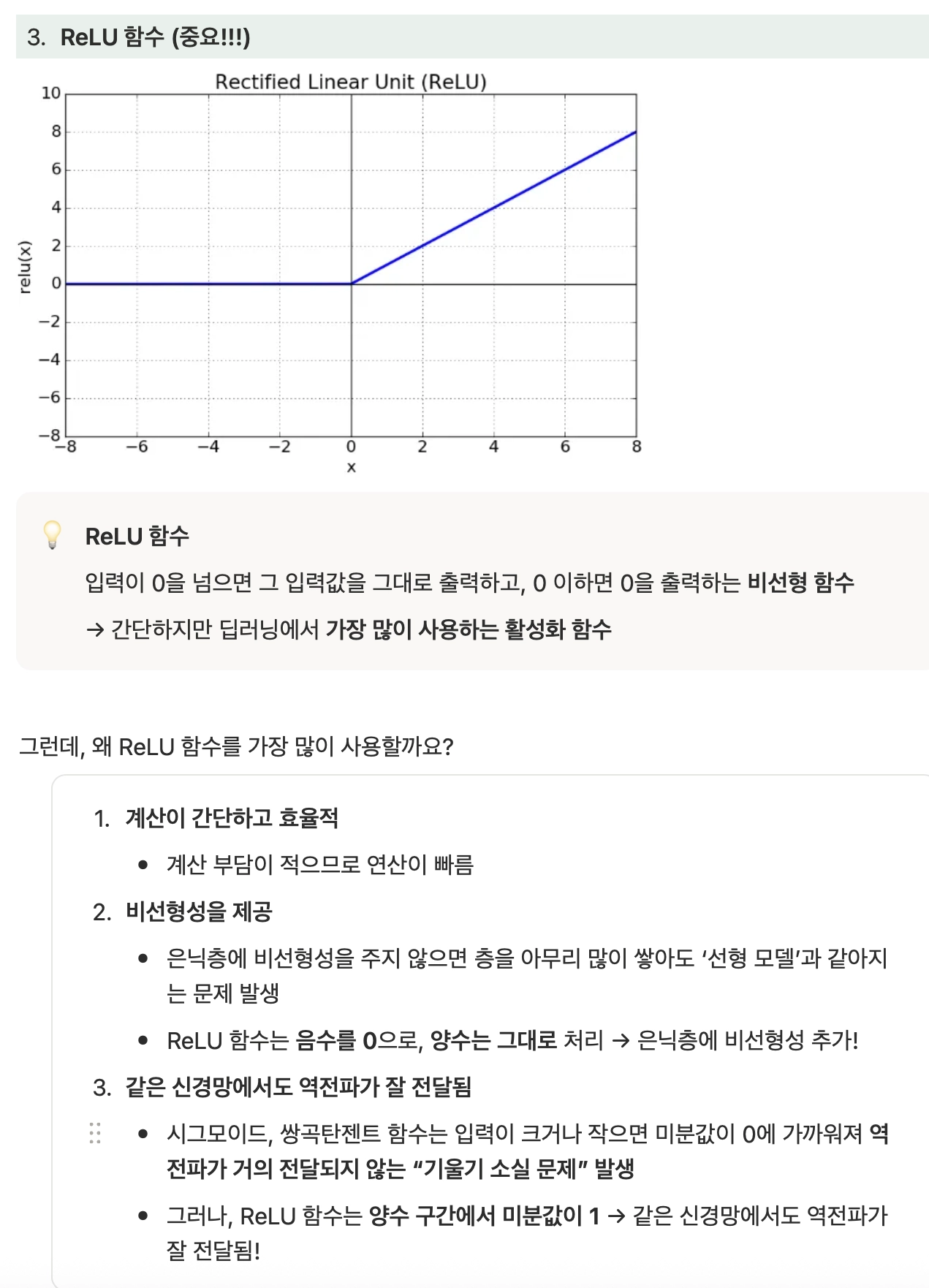

Session 2~4. 딥러닝

인공지능(AI), 머신러닝, 딥러닝의 개념을 살피고 비정형 데이터에 대해 자가학습 하는 딥러닝에 대해 공부했습니다. 인공신경망(Artificial Neural Network, ANN) 모델 내 의사결정 원리를 살피고 퍼셉트론의 구조와 다층화와 신경망으로의 연결, 구체적인 신경망 학습 모델을 다루었습니다

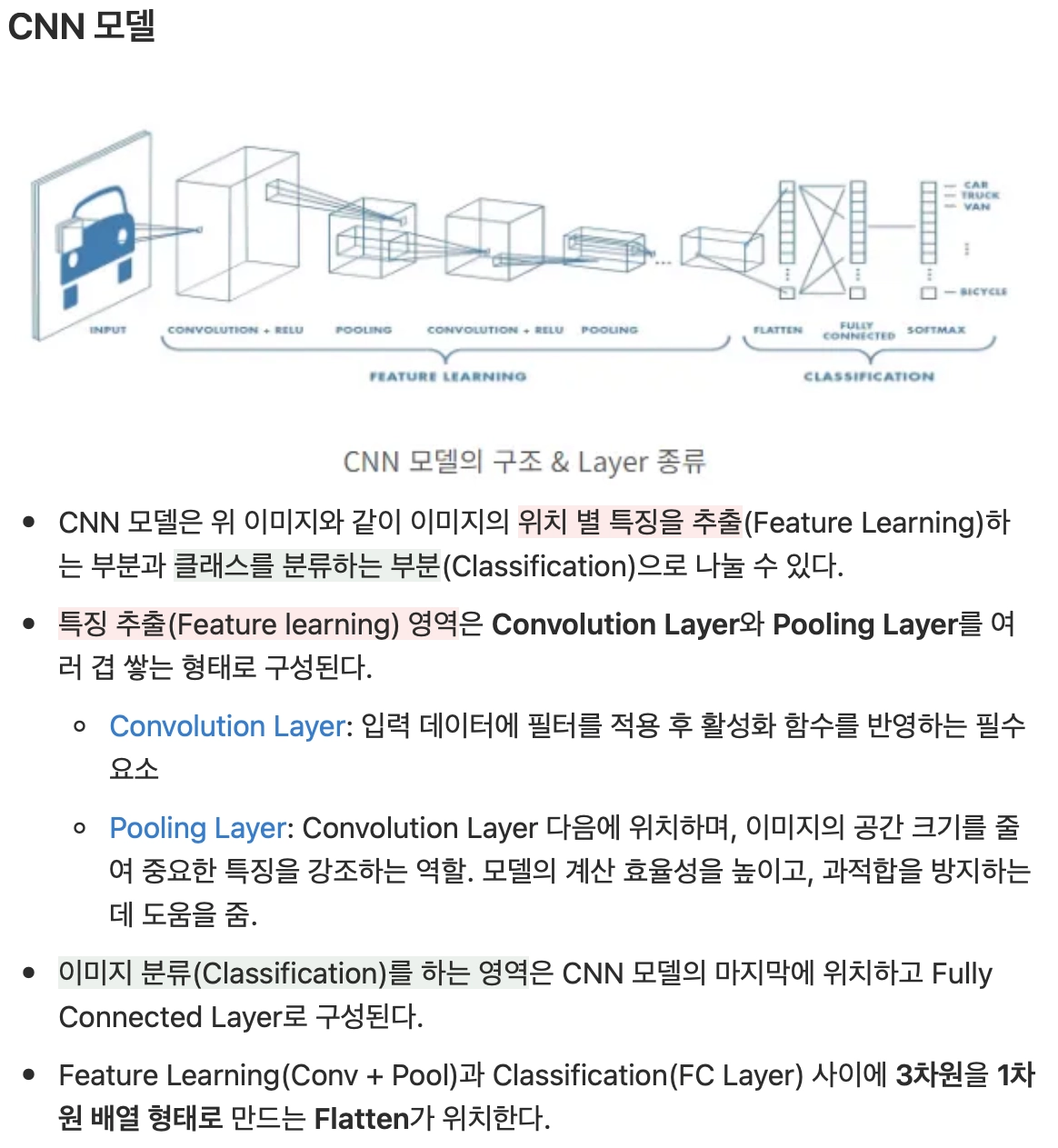

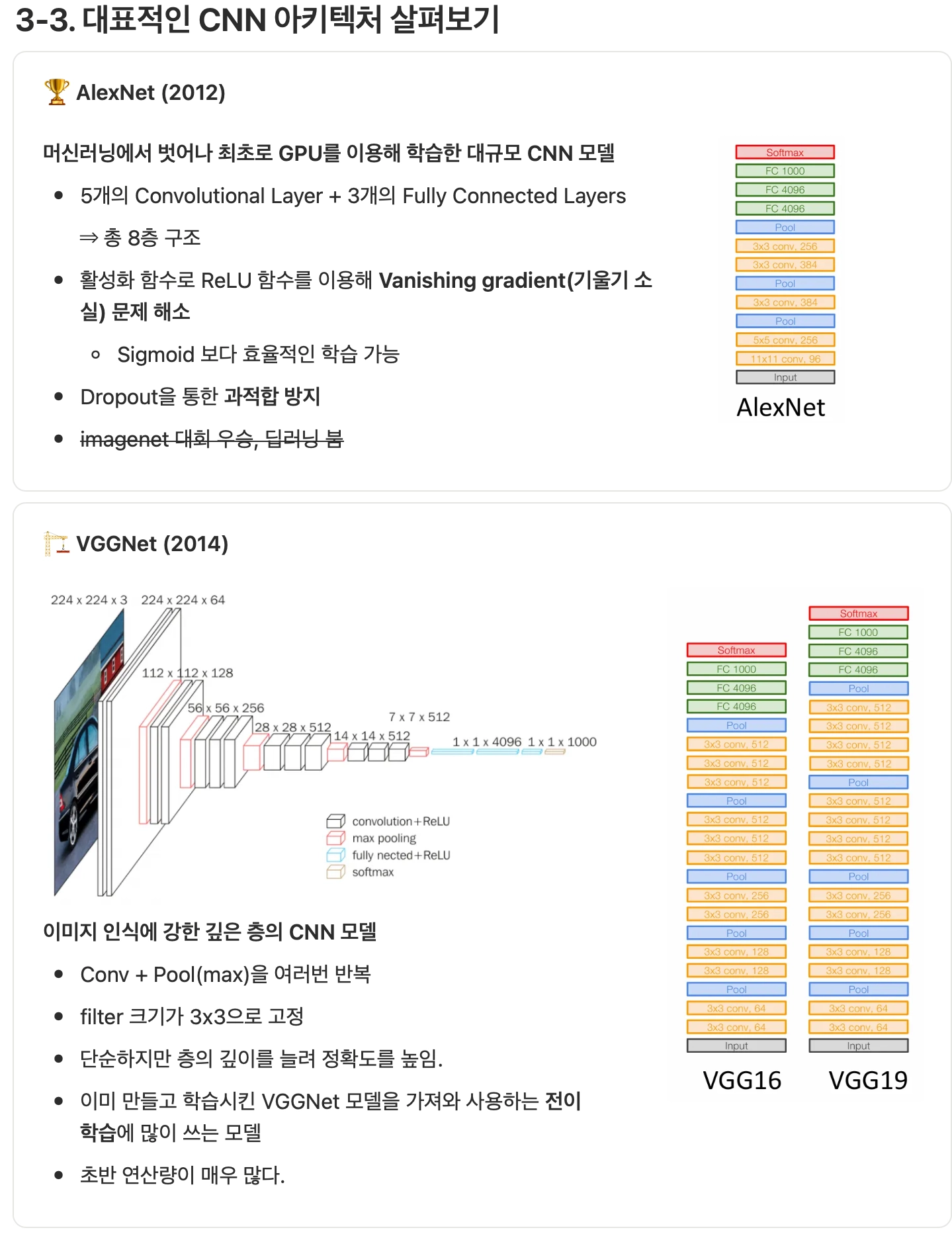

합성곱 신경망(CNN) 모델의 작동 원리와 대표적인 CNN 아키텍처를 살펴보고 이미지 딥러닝 응용 방법을 알아보았습니다.

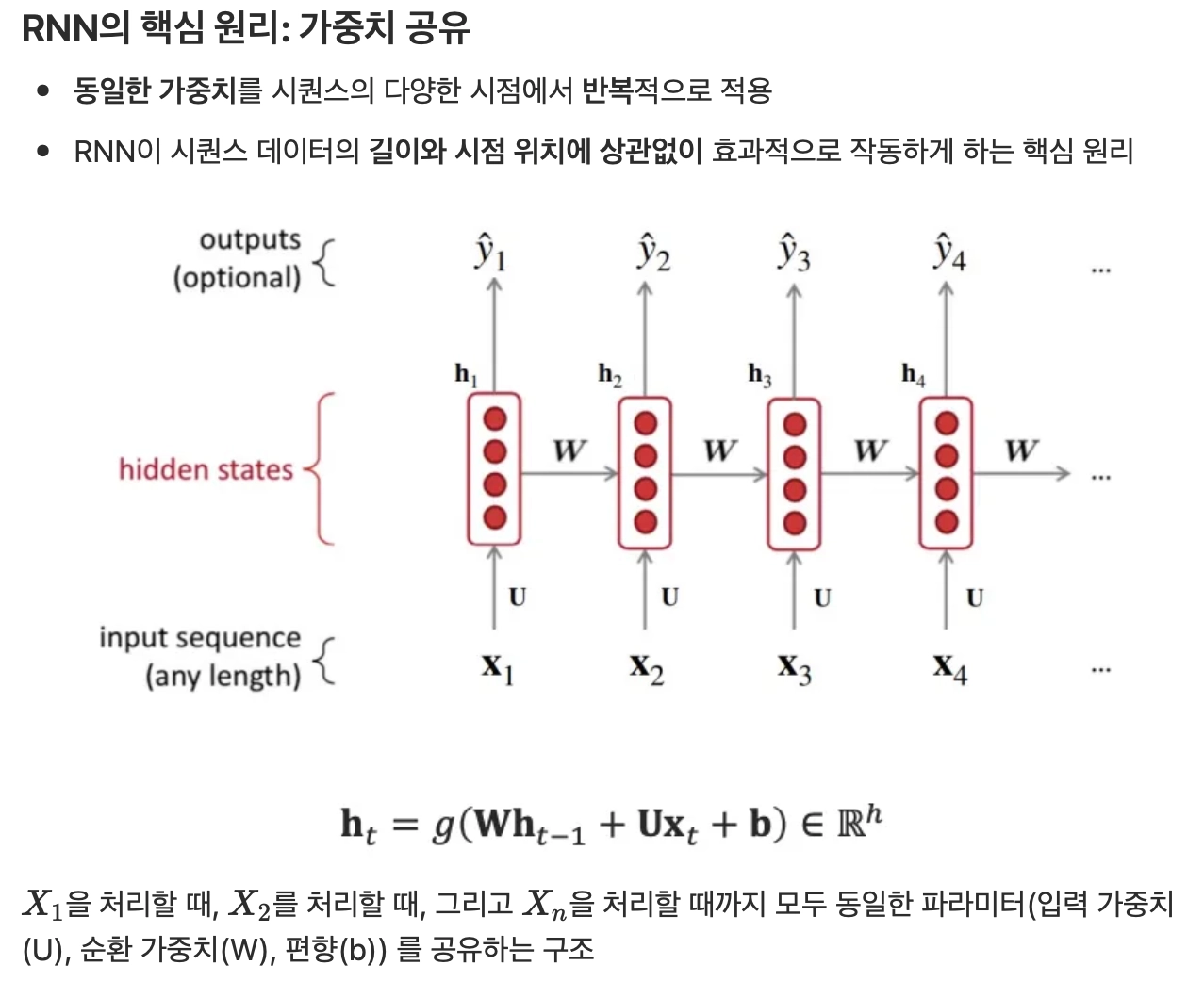

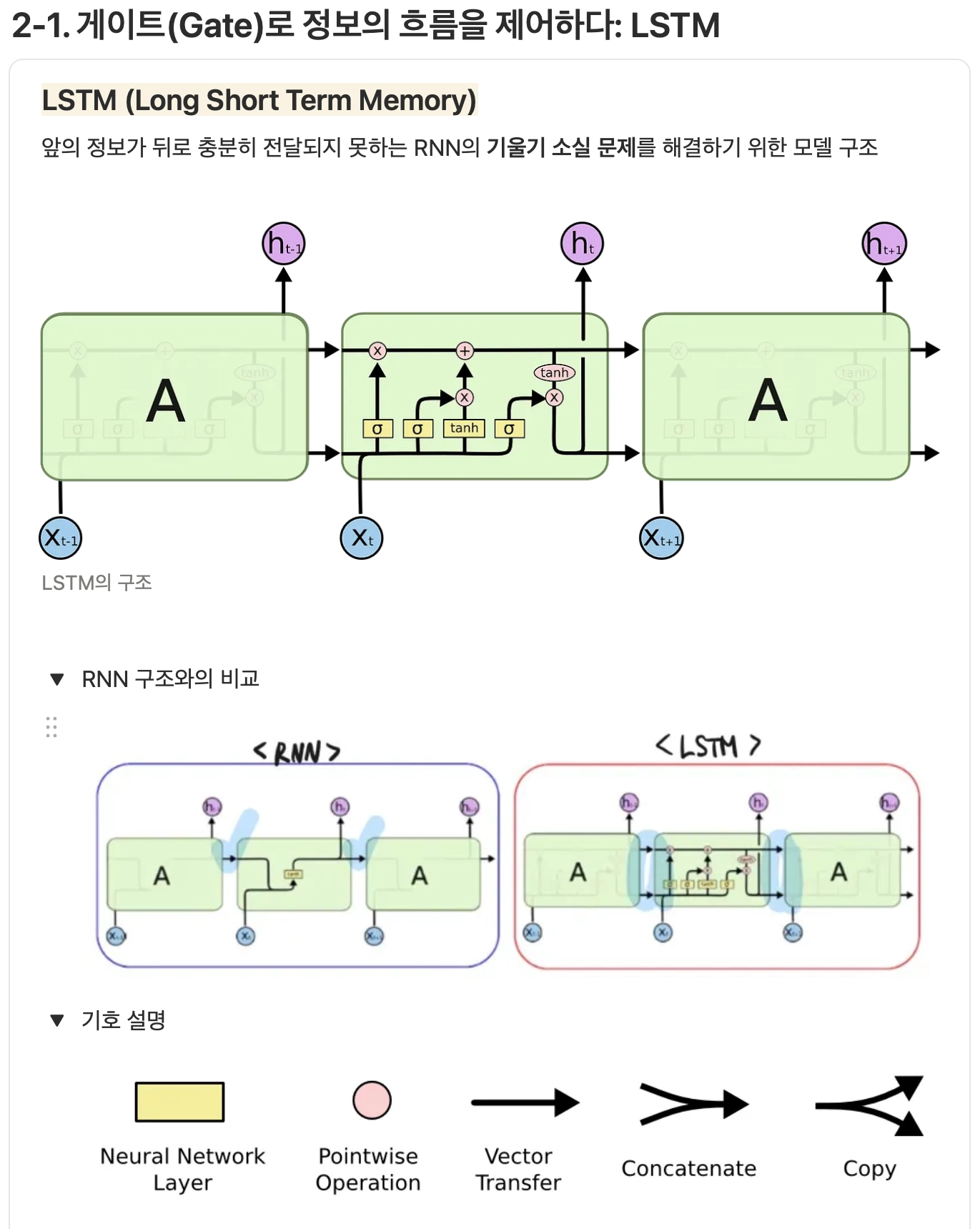

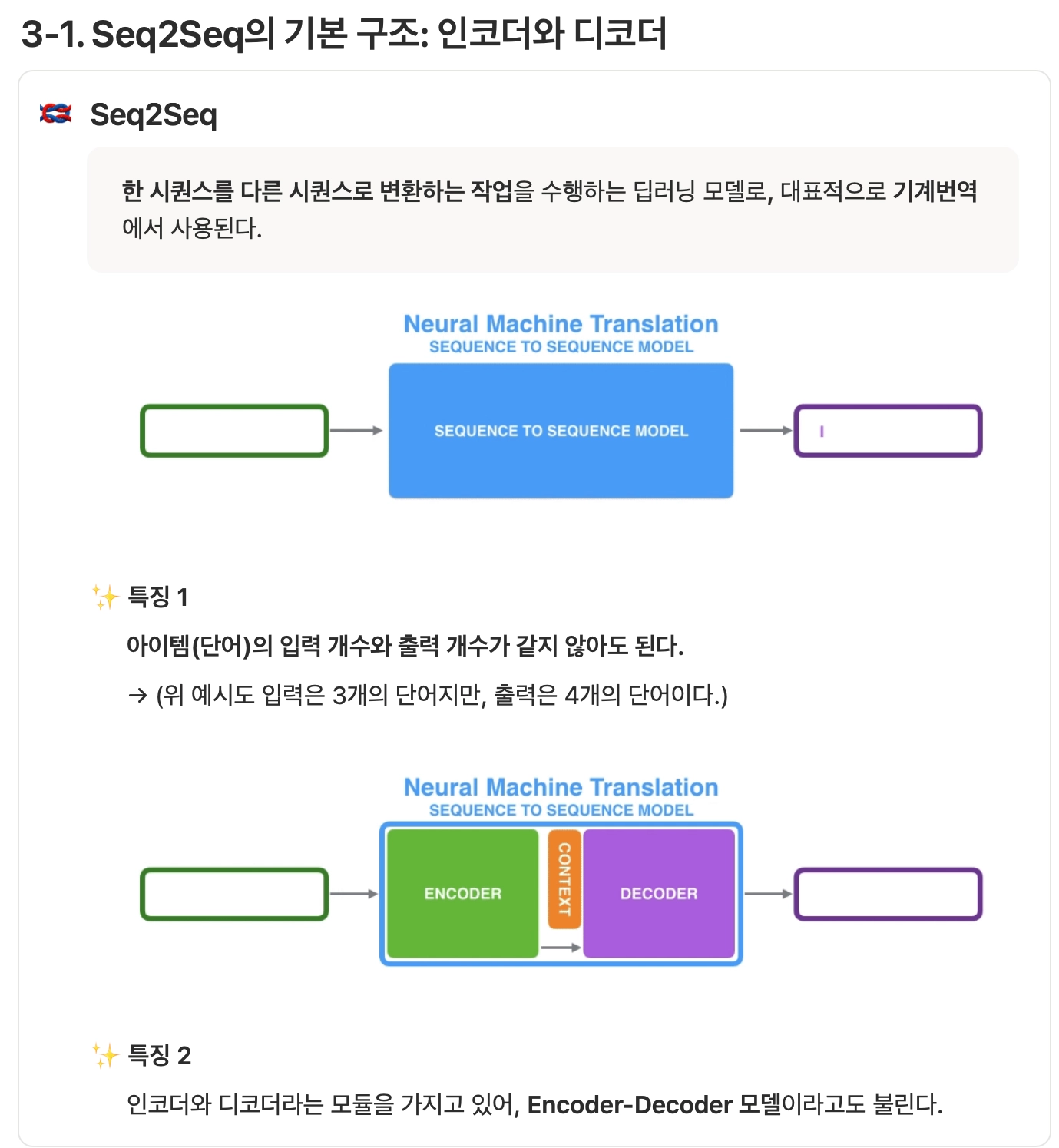

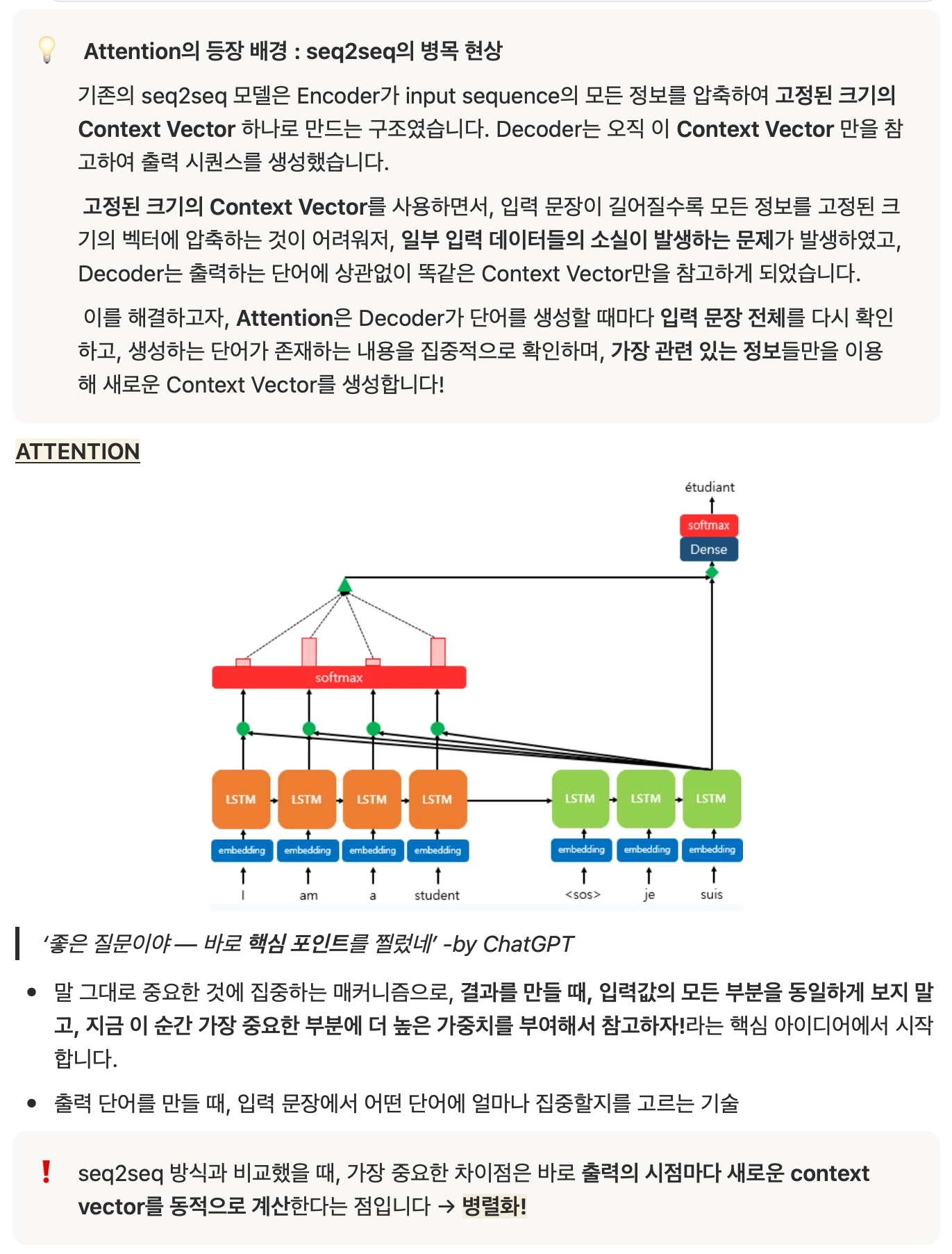

순차 데이터의 특성을 이해하며, 순차 데이터를 다루기 위해 등장한 RNN, LSTM, GRU, Seq2Seq의 구조와 원리, 한계를 알아보았습니다.

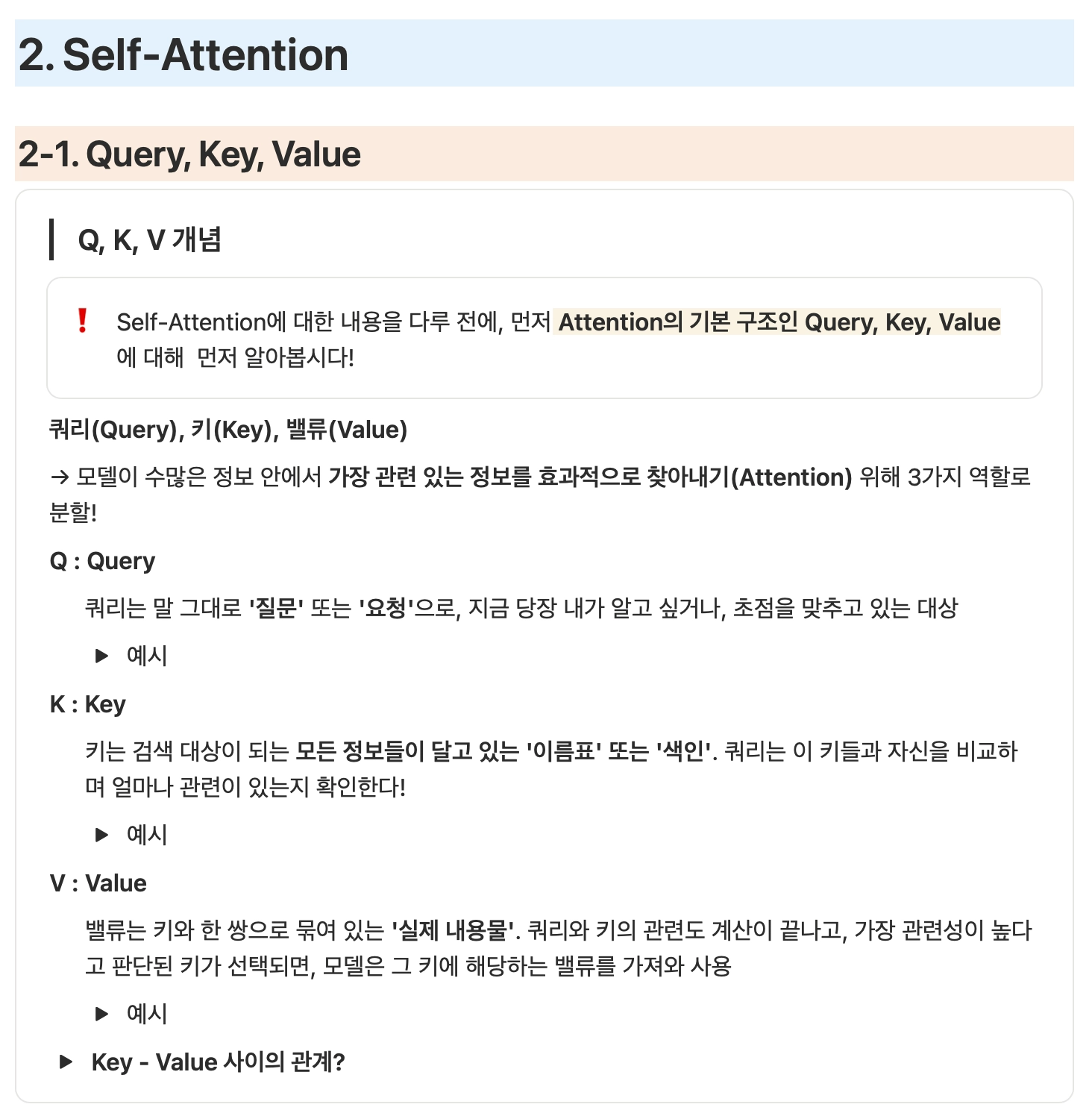

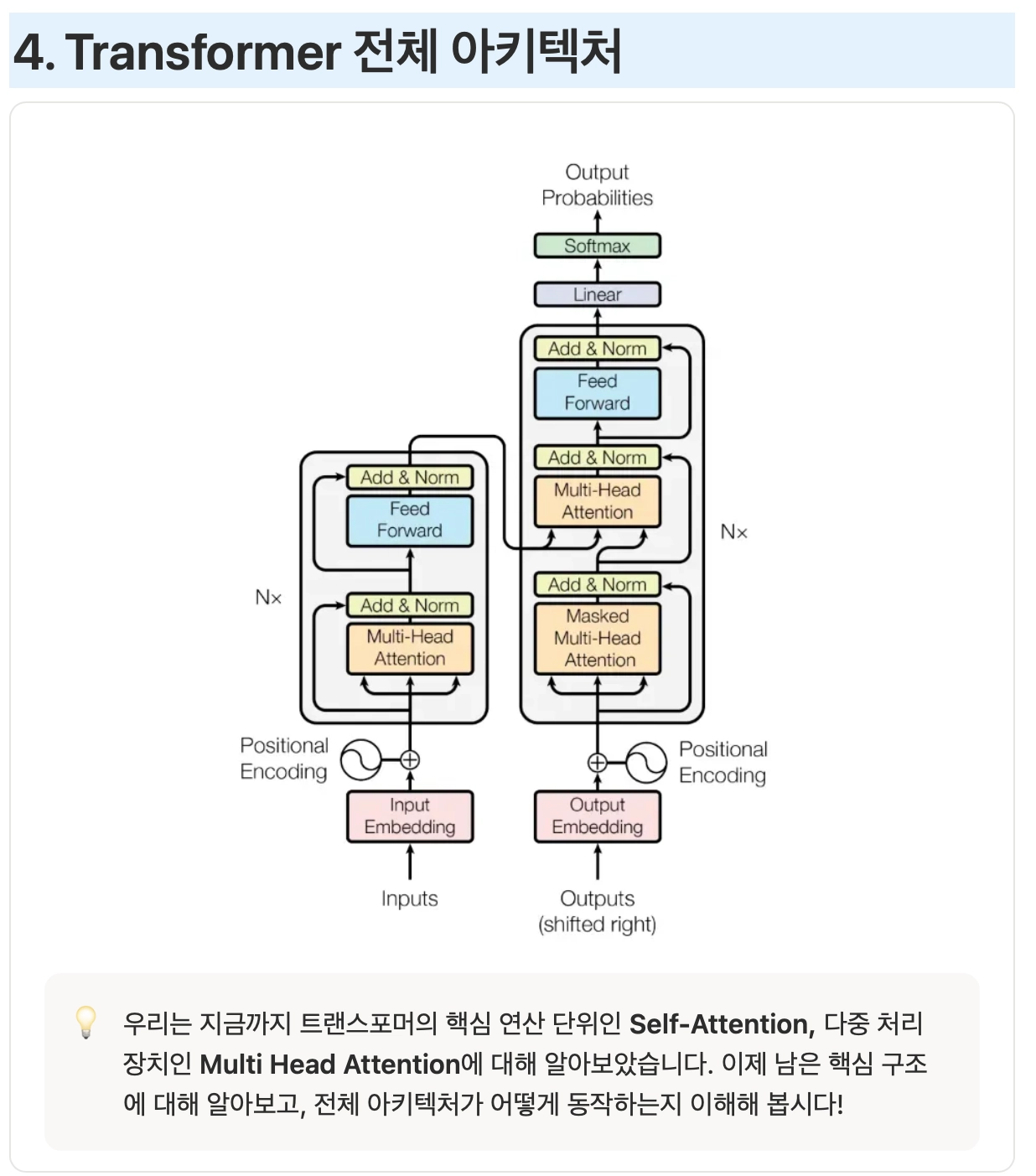

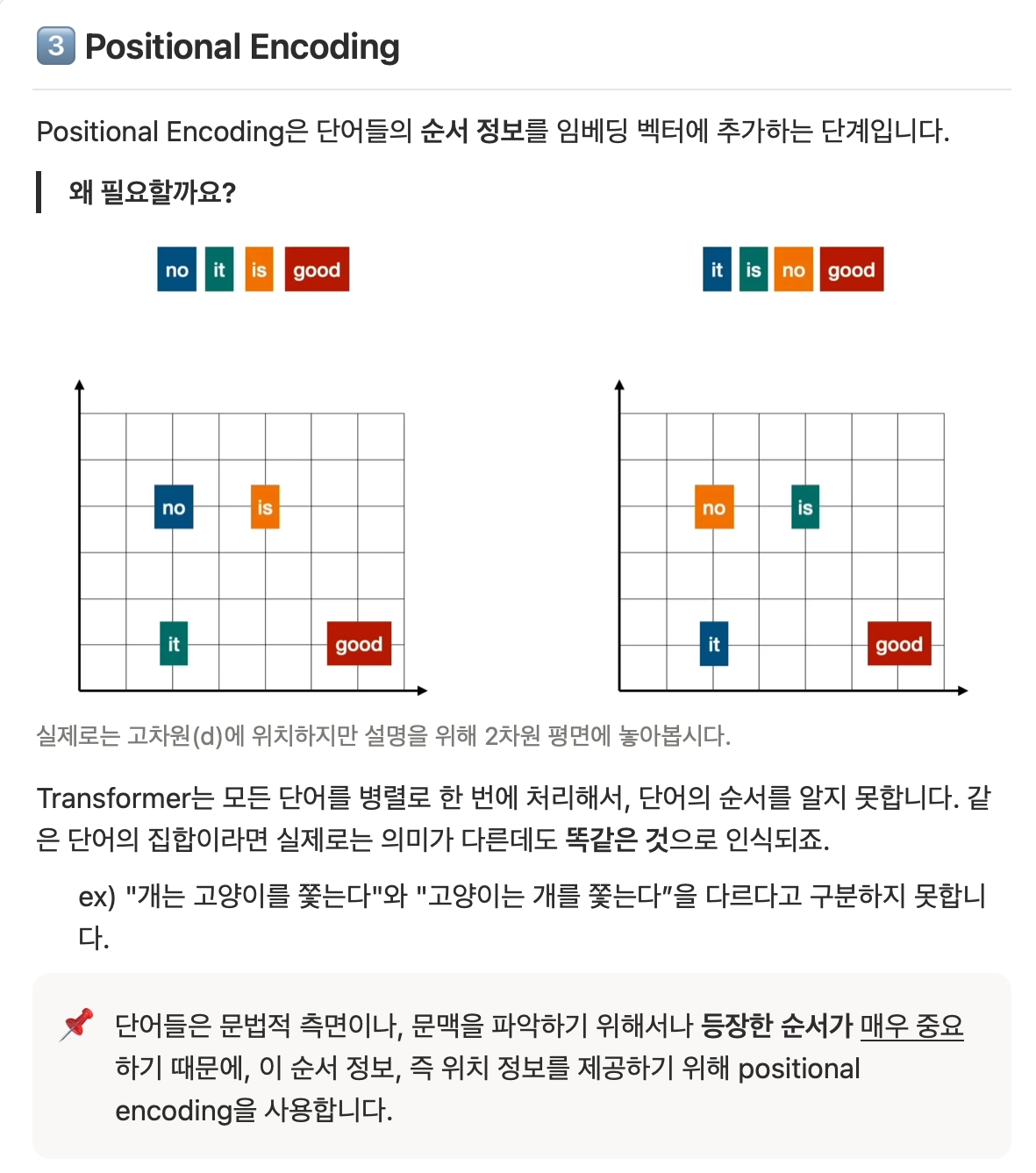

RNN / LSTM의 한계에 따른 Attention의 등장 배경을 알아보며 트랜스포머의 구조와 Multi-Head Attention이 어떻게 동작하는지 이해하였습니다.

‘Attention is All You Need(2017)’ 논문을 기반으로 트랜스포머의 아키텍처에 대해 이해하였습니다.

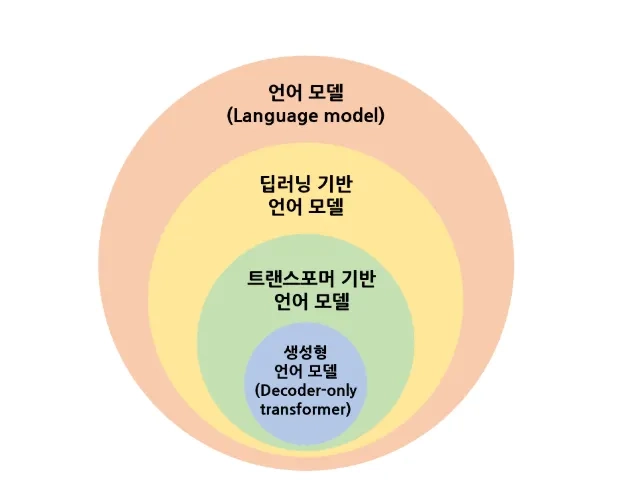

Session 5. 언어 모델&생성 모델

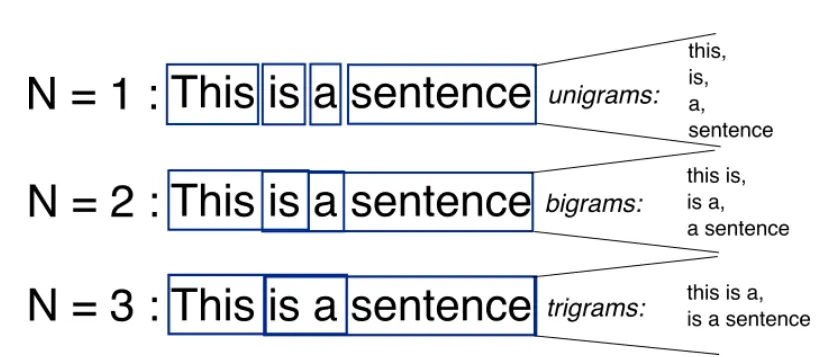

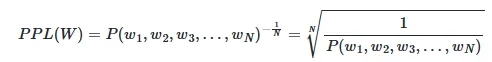

통계적 언어 모델(SLM)의 기반이 되는 분포 가설에 대해 학습했습니다. SLM에 속하는 N-GRAM과 Perplexity를 이해하는 데 필요한 수식과 작동 원리에 대해 살펴본 후, 딥러닝 기반 언어 모델인 LLM의 작동 방식과 사용 사례를 학습했습니다.

연속된 n개의 단어 묶음을 의미하는 N-Gram

Perplexity의 정의와 수식

언어 모델 관계도

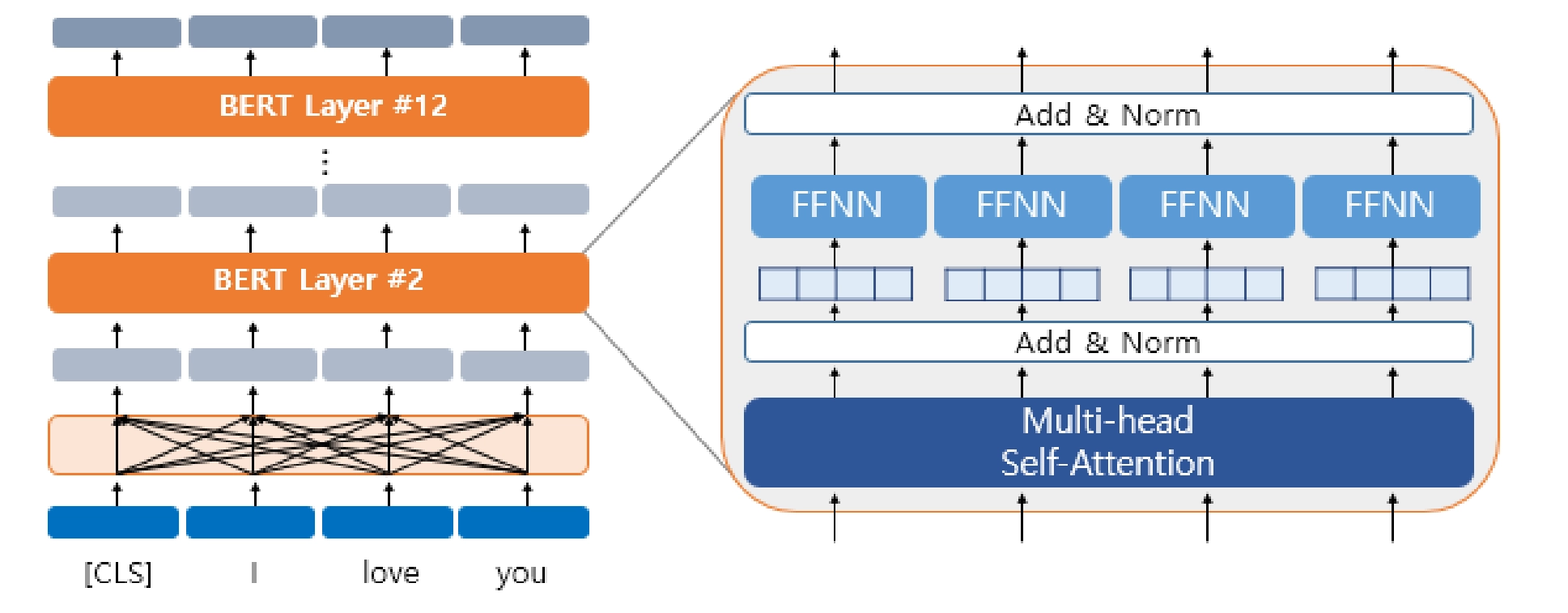

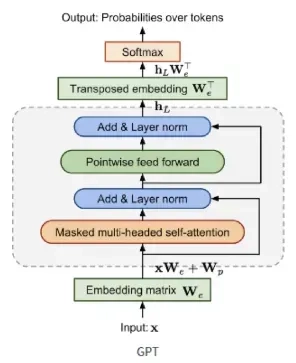

트랜스포머를 활용한 인코더, 디코더 기반의 모델인 BERT와 GPT를 구분하여 학습하였습니다.

BERT 모델에서의 self-Attention

GPT-1의 아키텍처

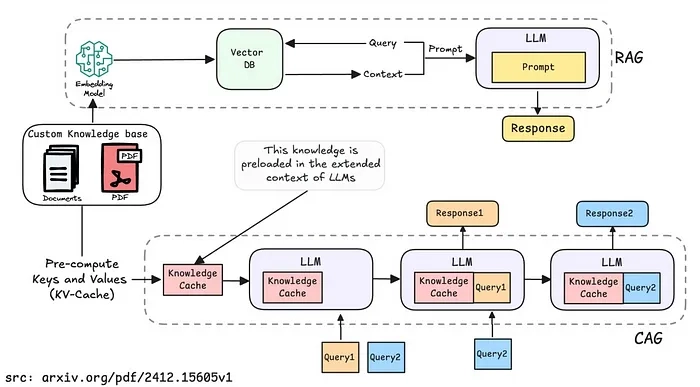

LLM의 한계인 환각 문제 극복을 위해 외부 지식 베이스를 연결해 모델의 성능을 높이는 RAG와, 모델이 문서의 신뢰도를 스스로 판단하고 활용하도록 훈련하는 CAG에 대해 학습했습니다. LLM을 활용하는 개발 프레임워크인 랭체인에 대해서 알아보았습니다.

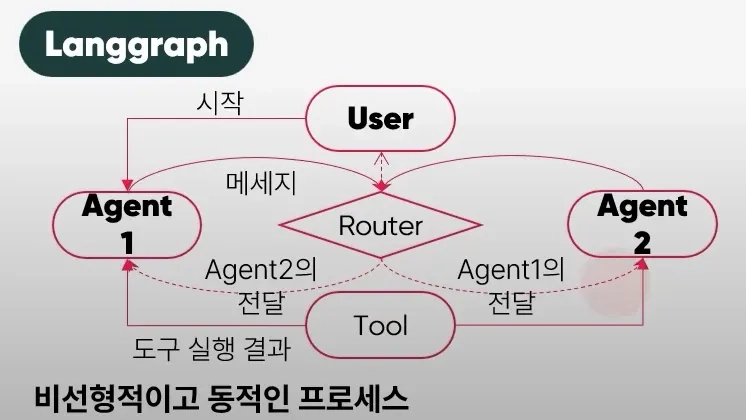

복잡한 로직 구현이 어려운 랭체인의 한계를 극복한 랭그래프와 랭스미스에 대해서도 살펴보았습니다.

RAG와 CAG 구조 비교

랭체인 구조

랭그래프 구조

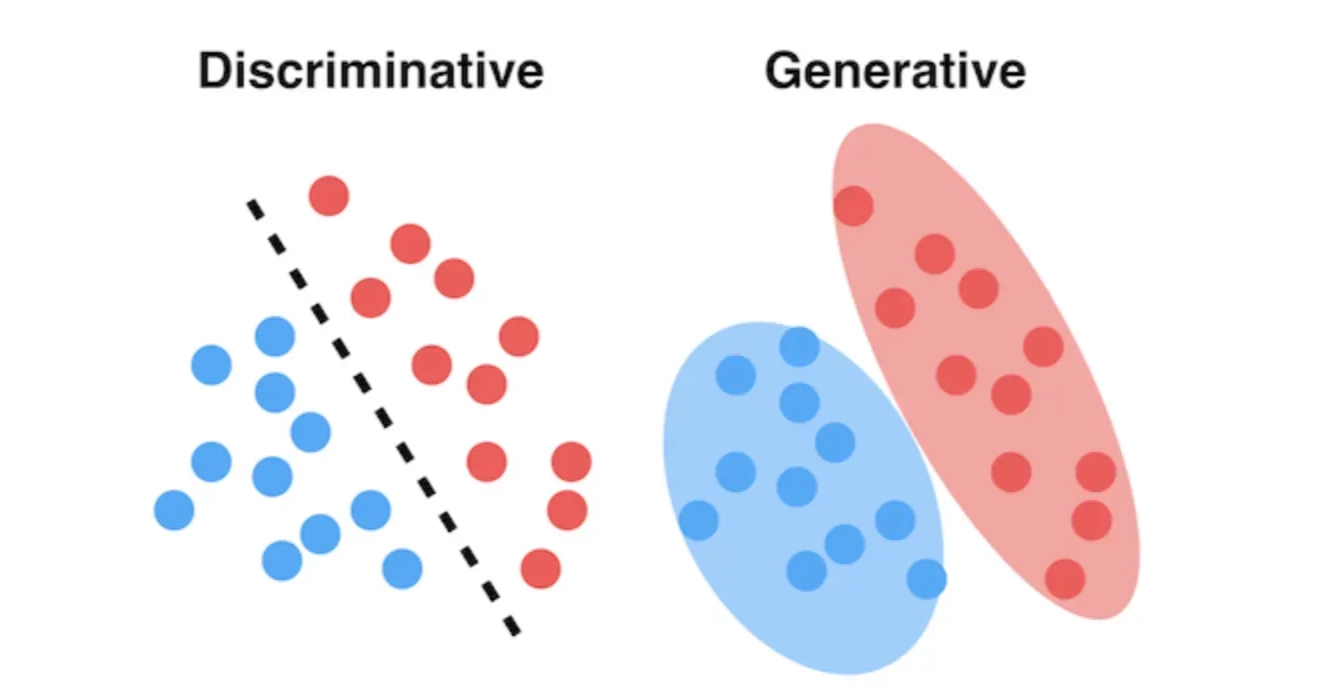

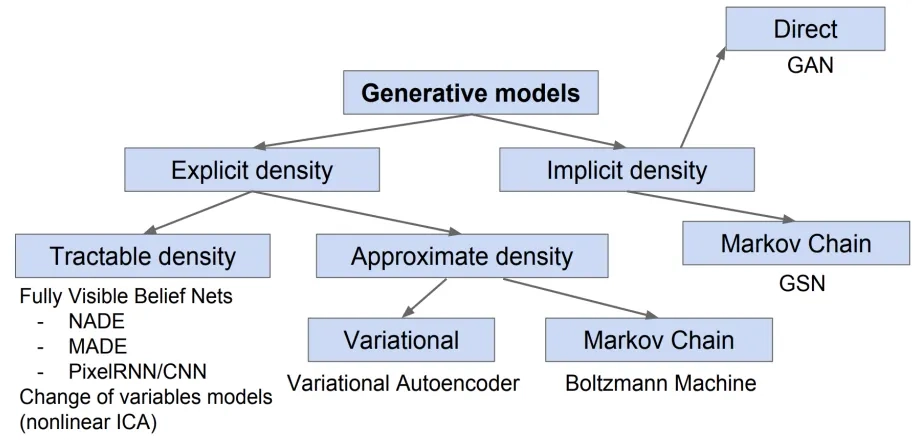

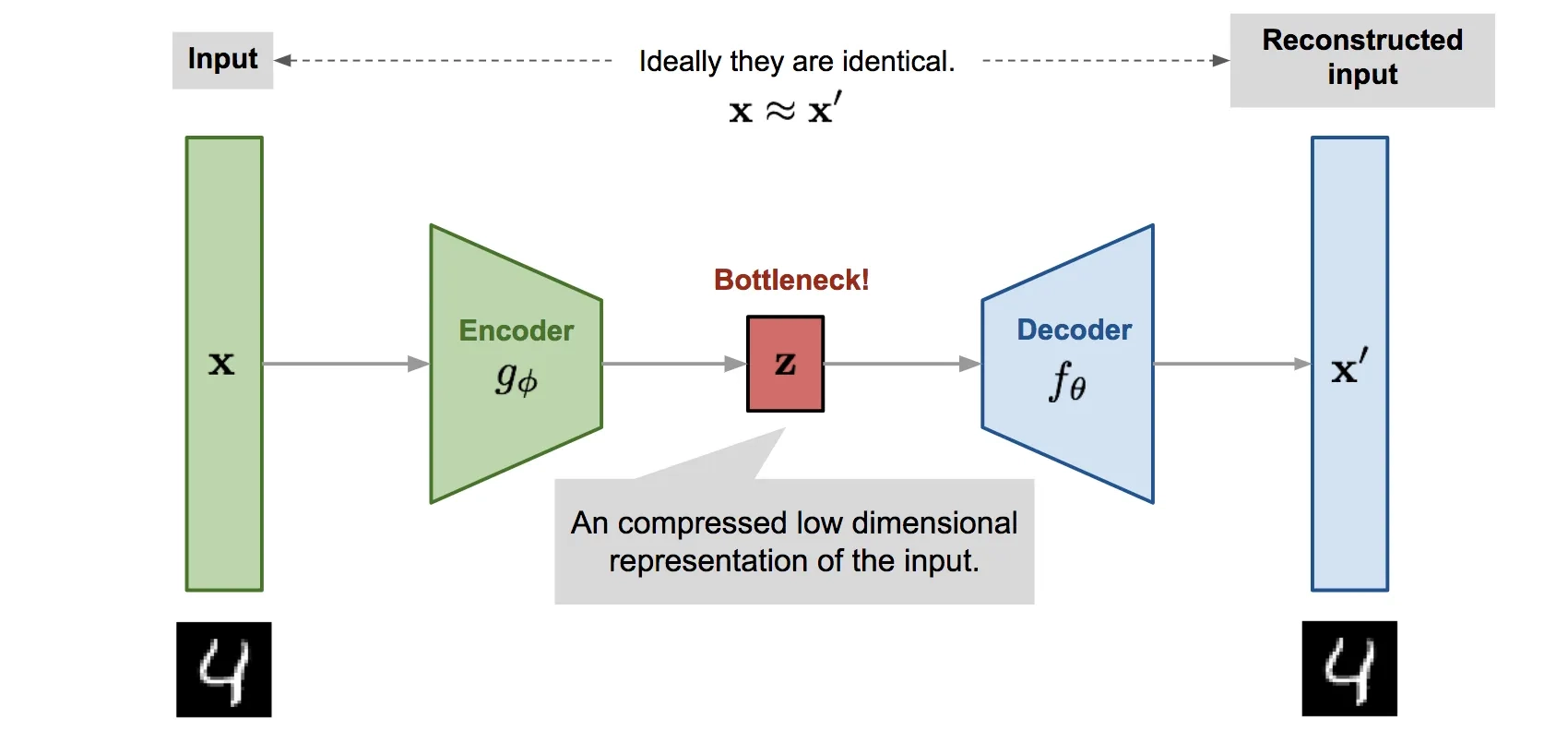

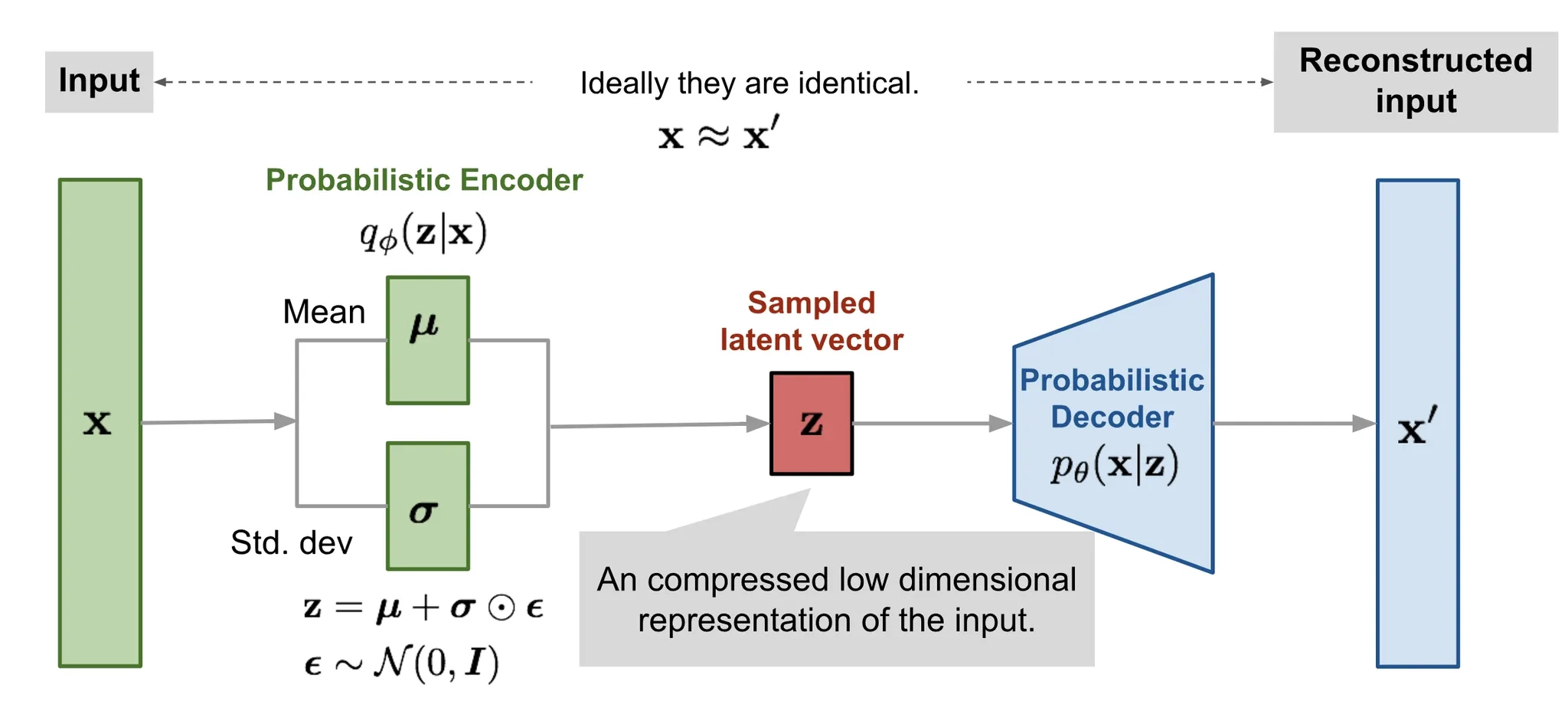

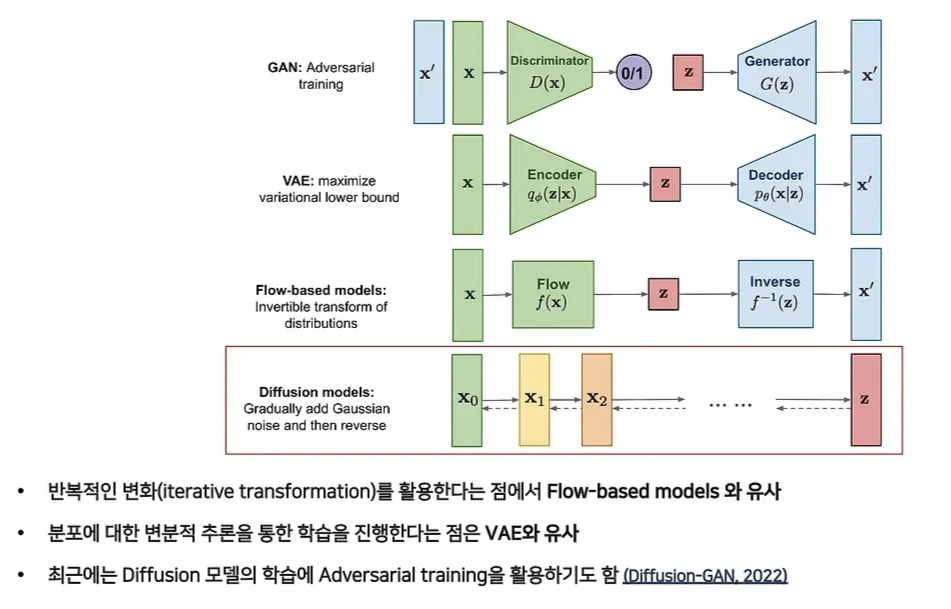

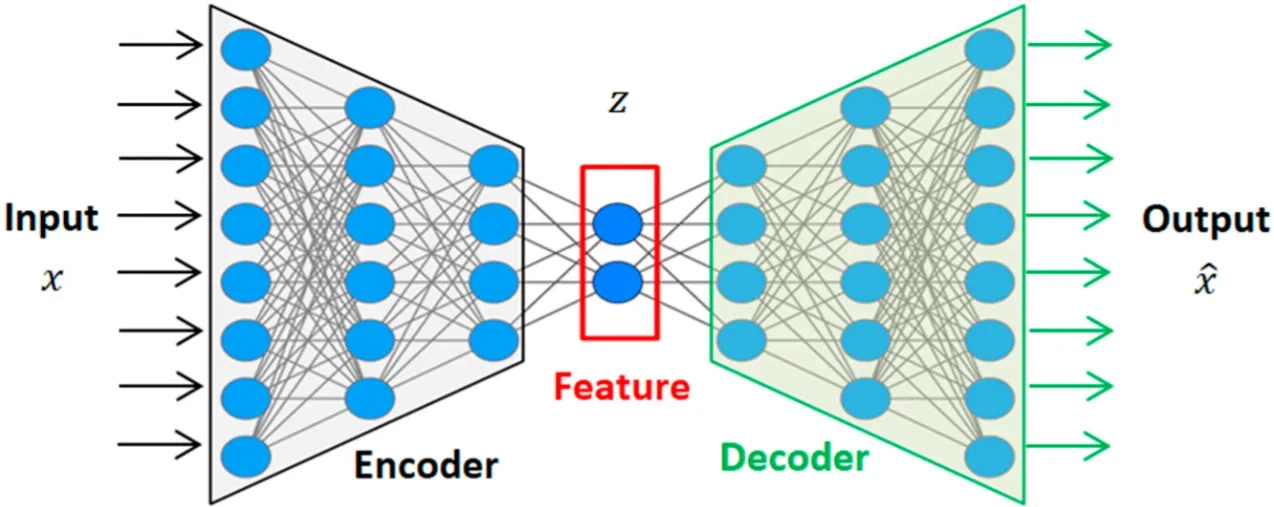

주어진 학습 데이터를 활용해 분포를 따르는 유사한 데이터를 생성하는 생성 모델 중 VAE, GAN, 확산 모델의 핵심 아키텍처와 데이터 분포를 익혔습니다.

분류 모델과 생성 모델의 차이점

생성 모델의 분류

AE 모델의 구조

VAE 모델의 구조

GAN, 확산 모델의 구조

Session 6. 추천시스템 심화

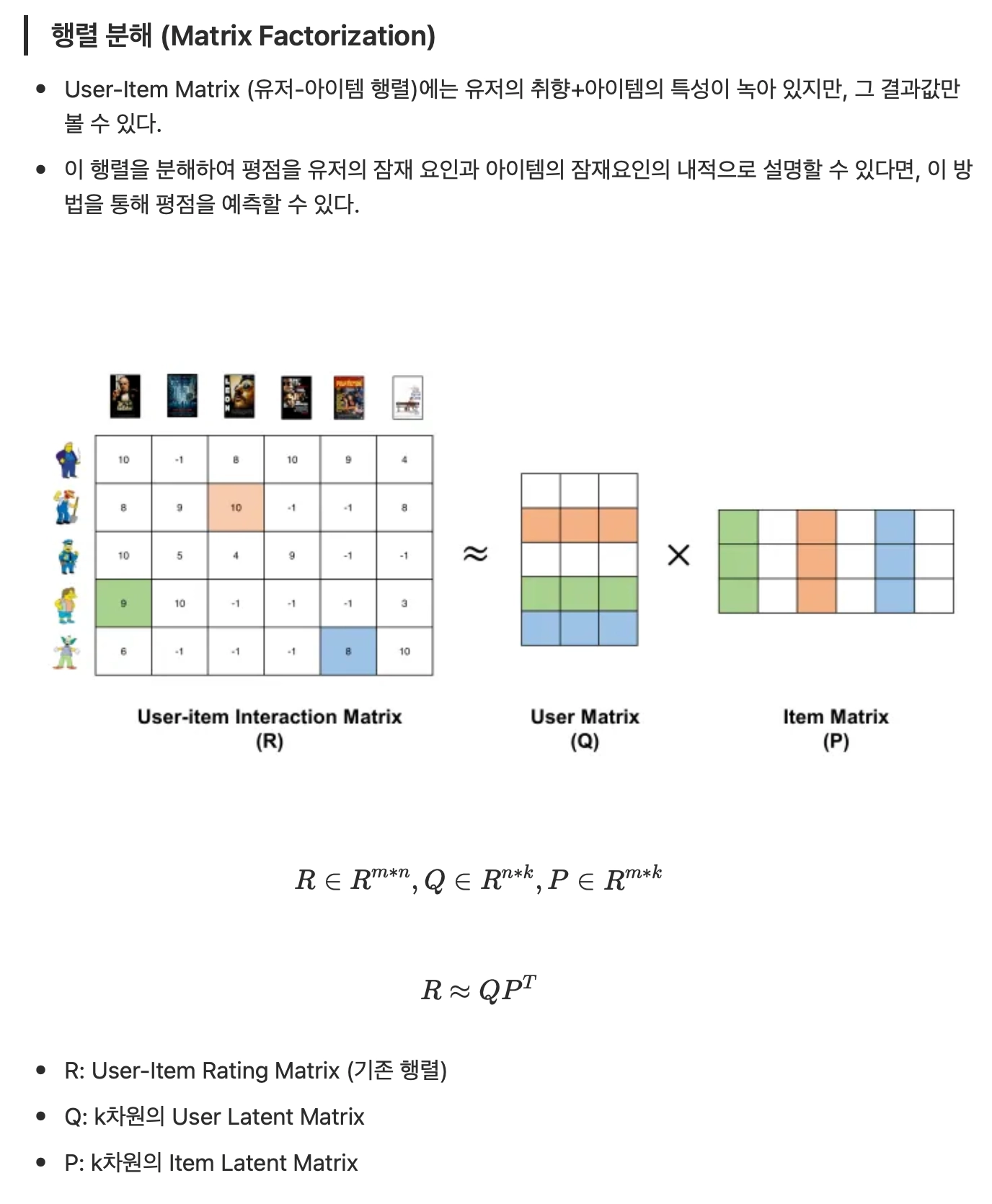

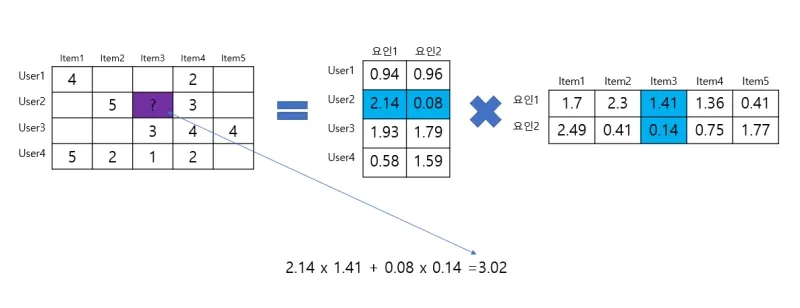

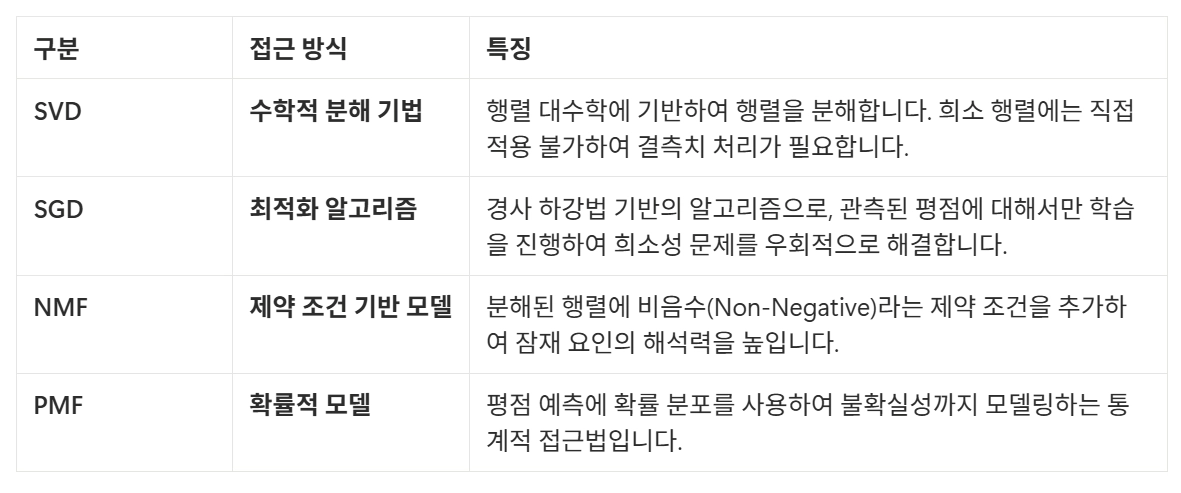

교육 세션에서 학습한 추천시스템 내용을 복습한 후, 기존 협업 필터링의 한계인 희소성과 확장성 문제를 해결하는 잠재 요인과 행렬 분해를 익혔습니다.

잠재 요인과 행렬 분해

행렬 분해 종류

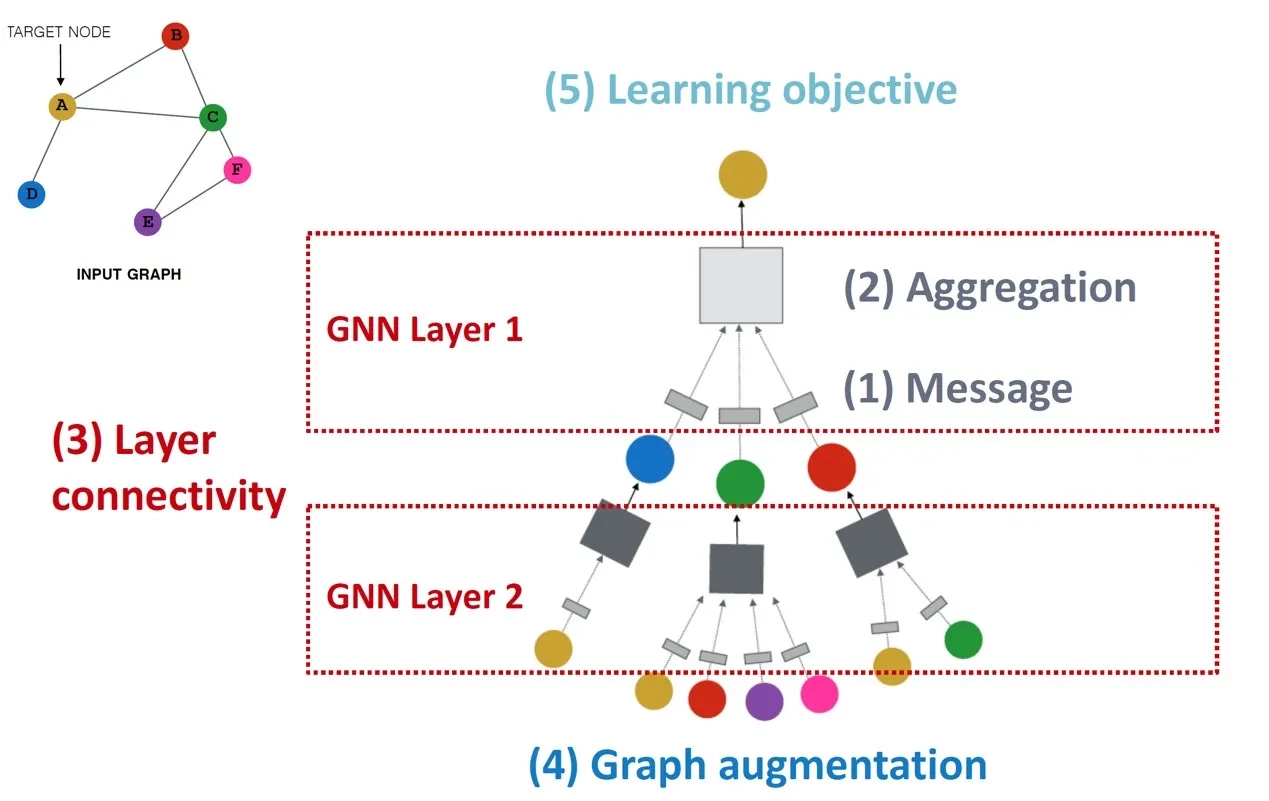

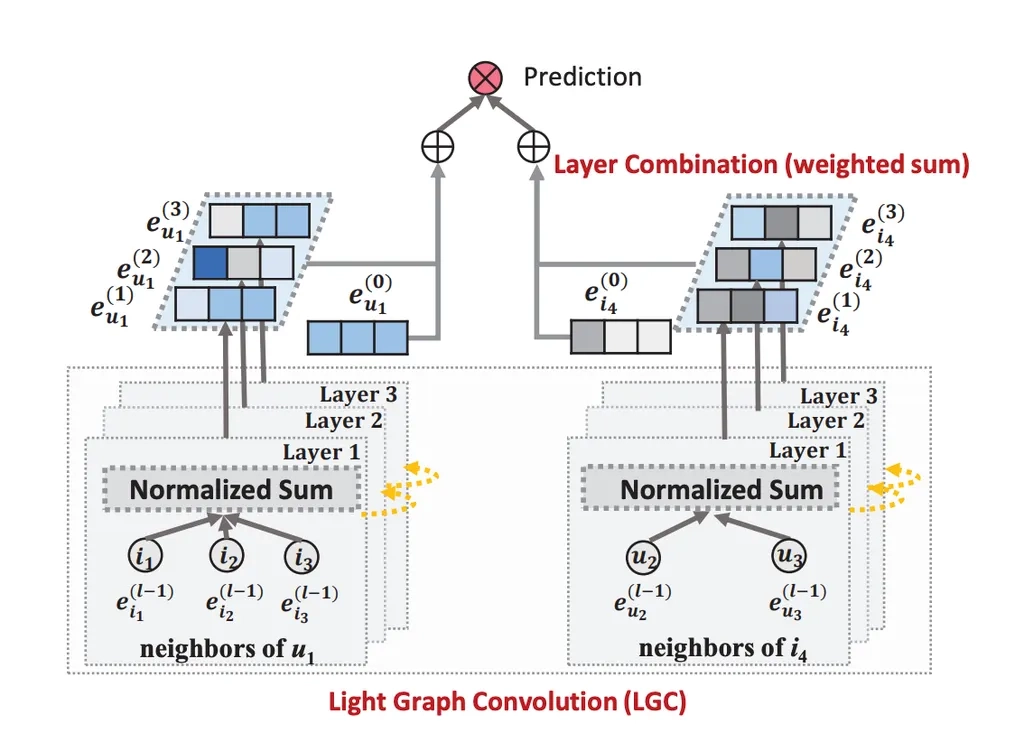

최근 추천시스템의 방향성인 VAE, GNN 등 딥러닝 아키텍처로 확장하여 복잡한 비선형 관계와 행동 순서를 파악하는 방법을 학습했습니다.

최근 추천시스템의 방향성

VAE 기반 협업 필터링

VAE 목적 함수

GNN의 작동 프로세스

LightGCN의 아키텍처

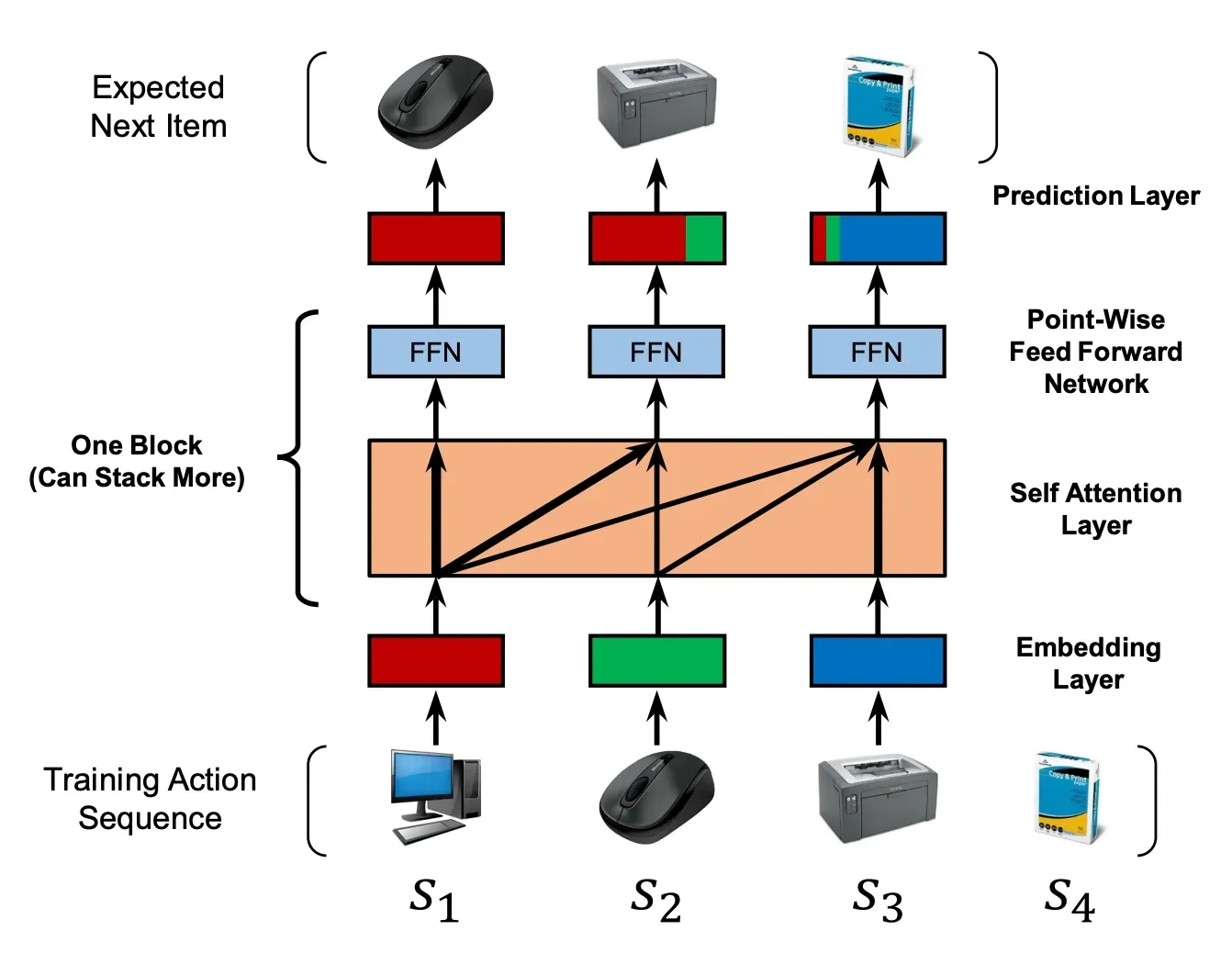

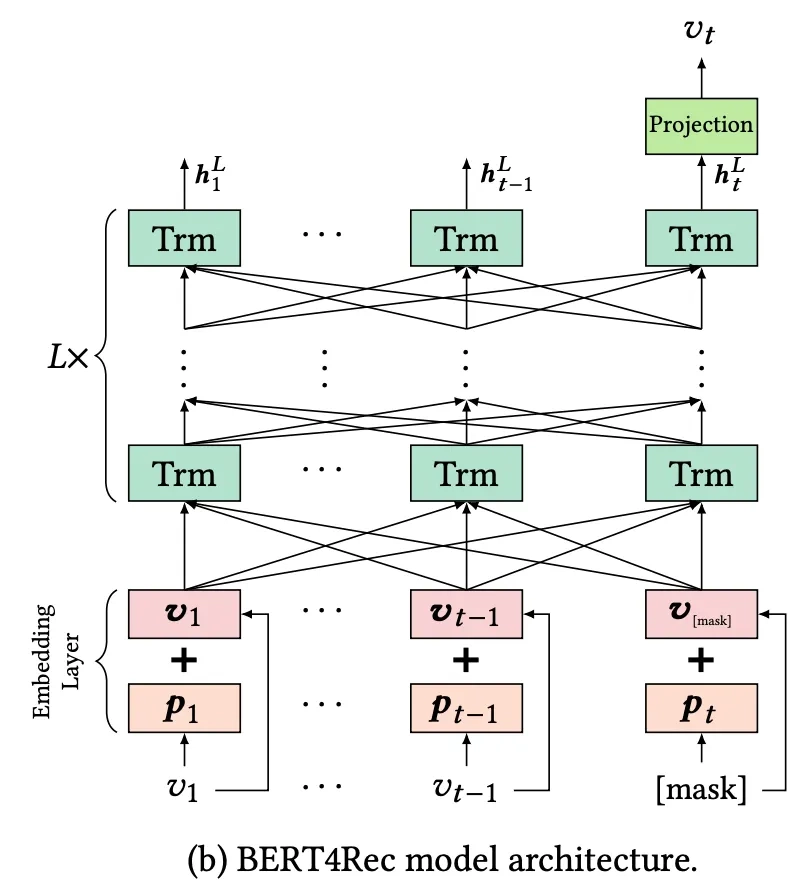

딥러닝 아키텍처 중 시퀀스 내의 문맥과 핵심 의도를 파악하는 데 강력한 트랜스포머 구조를 추천시스템에 적용한 SASRec과 BERT4Rec의 원리를 학습했습니다. 또한, 추천을 언어의 문제로 변화시키고 있는 LLM 기반 추천시스템에 대해 살펴보았습니다.

SASRec의 원리

BERT4Rec의 원리

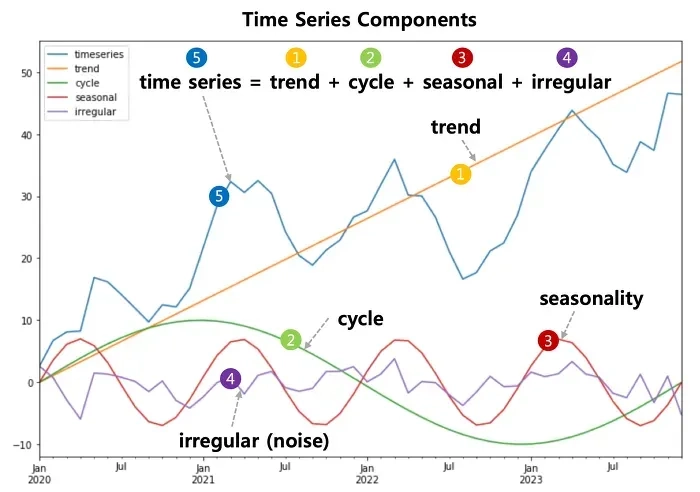

Session 7~8. 시계열

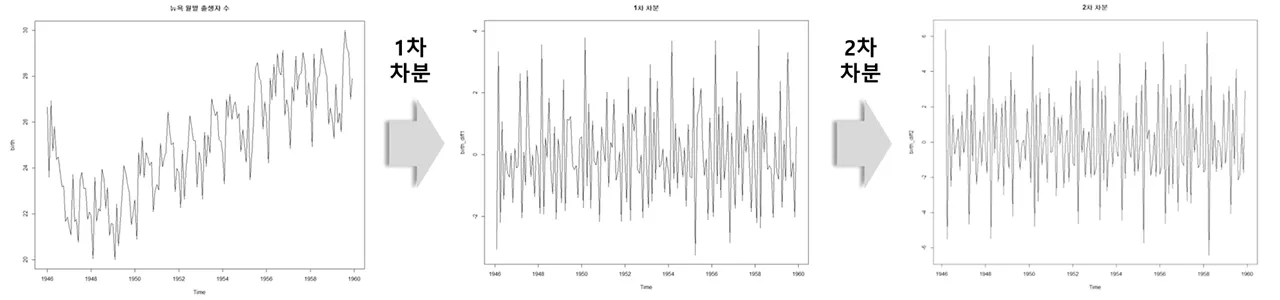

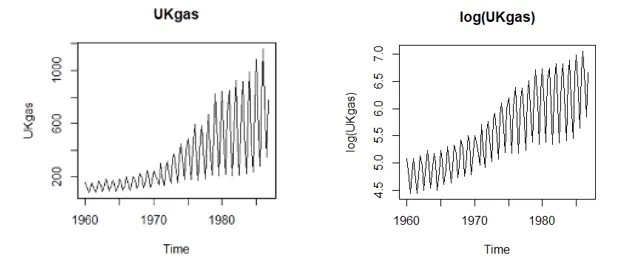

시계열 데이터의 정의, 종류와 함께 시간 의존성, 자기상관, 추세, 계절성 같은 핵심 통계적 특성을 학습했습니다. 시계열을 추세, 계절성, 순환, 불규칙 요인으로 분해하는 기법을 익히고, 분석의 전제 조건인 정상성(Stationarity)의 개념과 중요성에 대해 학습하였습니다. 또한, 시각적 탐색 및 통계 검정을 통해 정상성을 판단하고, Pandas를 활용해 데이터를 다루며 정상성을 확보하는 다양한 방법들을 살펴보았습니다.

시계열에서의 추세성, 계절성, 주기성, 불규칙 요인

시계열에서의 차분

시계열 데이터는?

(1) 자기상관성(Autocorrelation)

(2) 비정상성(Non-stationarity)

(3) 계절성(Seasonality)

로그 변환을 통한 분산 안정화

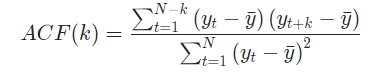

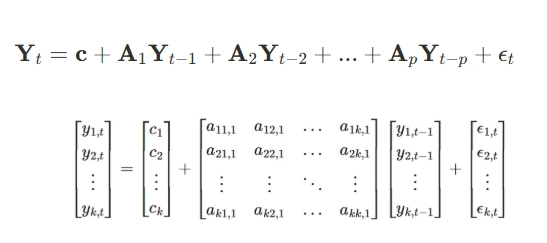

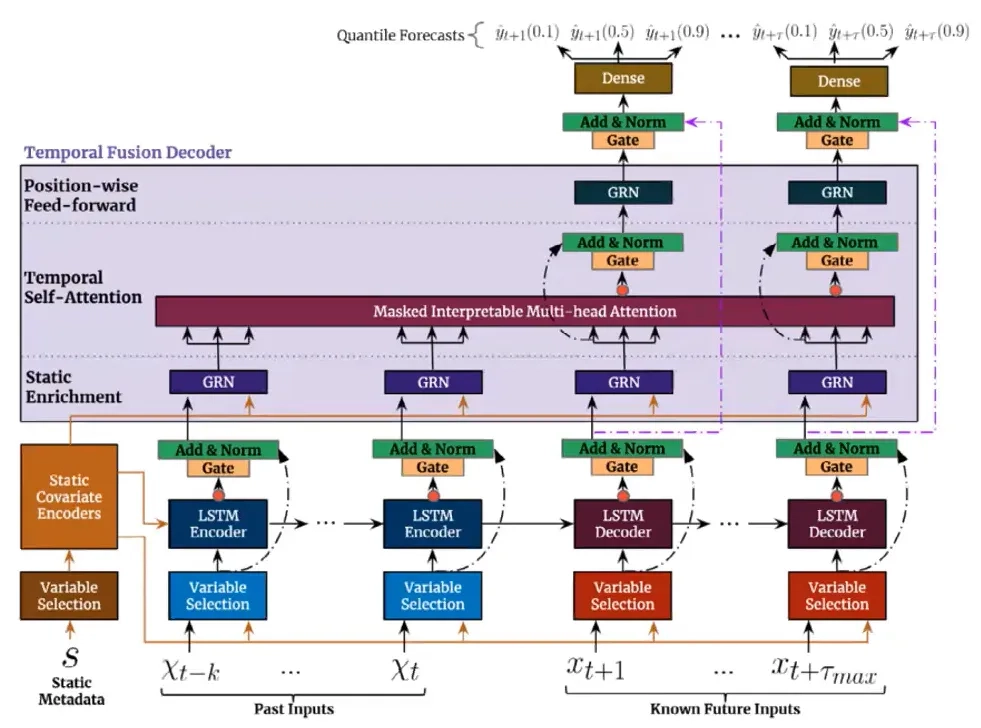

단변량/다변랑 시계열 모델을 살펴보았습니다. 단변량 시계열 모델은 안정적/ 불안정 시계열 모델로 구분하여 AR, MA, ARMA / ARIMA, SARIMA에 대해 학습했습니다. VAR을 통해 다변량 시계열 분석을 공부하고, RNN, Transformer 기반의 딥러닝 모델과 Foundation model에 대해 알아보았습니다.

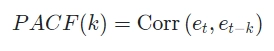

자기상관함수(Auto Correlation Function, ACF)

VAR 모델 수식

부분자기상관함수(Partial ACF, PACF)

다중 시점 시계열 예측 모델 : TFT

Session 9. AI 트렌드

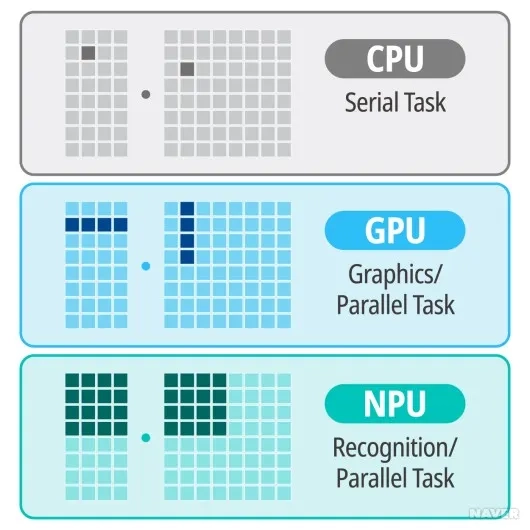

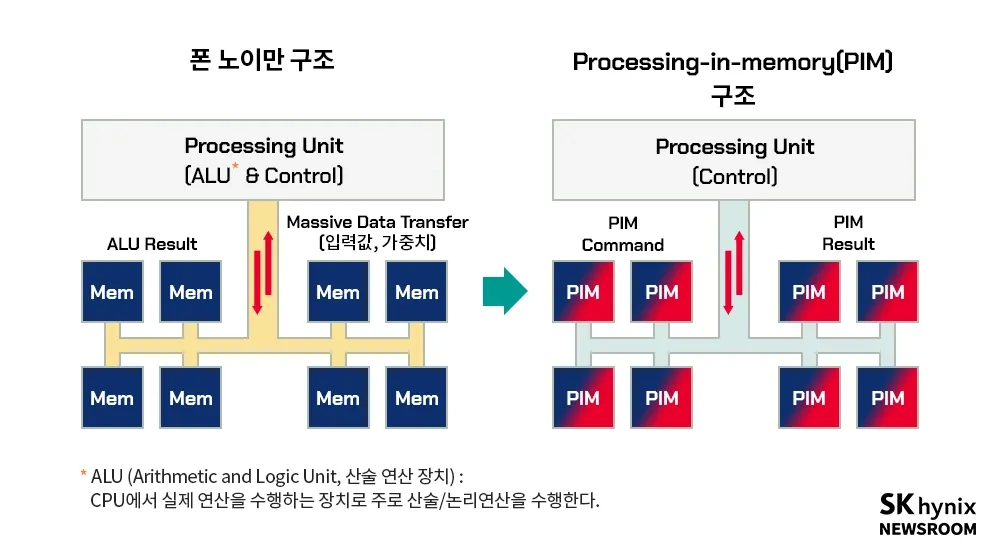

컴퓨터 구조와 하드웨어의 진화가 AI 성능 향상에 미친 영향을 CPU→GPU→NPU→PIM 순으로 파악했습니다.

CPU, GPU, NPU 비교

메모리 내부에 연산 장치를 심어, 데이터의 저장 위치에서 바로 계산하는 PIM

빅테크 기업으로 최근 5개년 AI의 트렌드 흐름을 파악했습니다. 생성에서 나아가 자율적으로 판단하고 행동하는 Agentic AI 시대로 접어든 최신 트렌드를 학습했습니다.

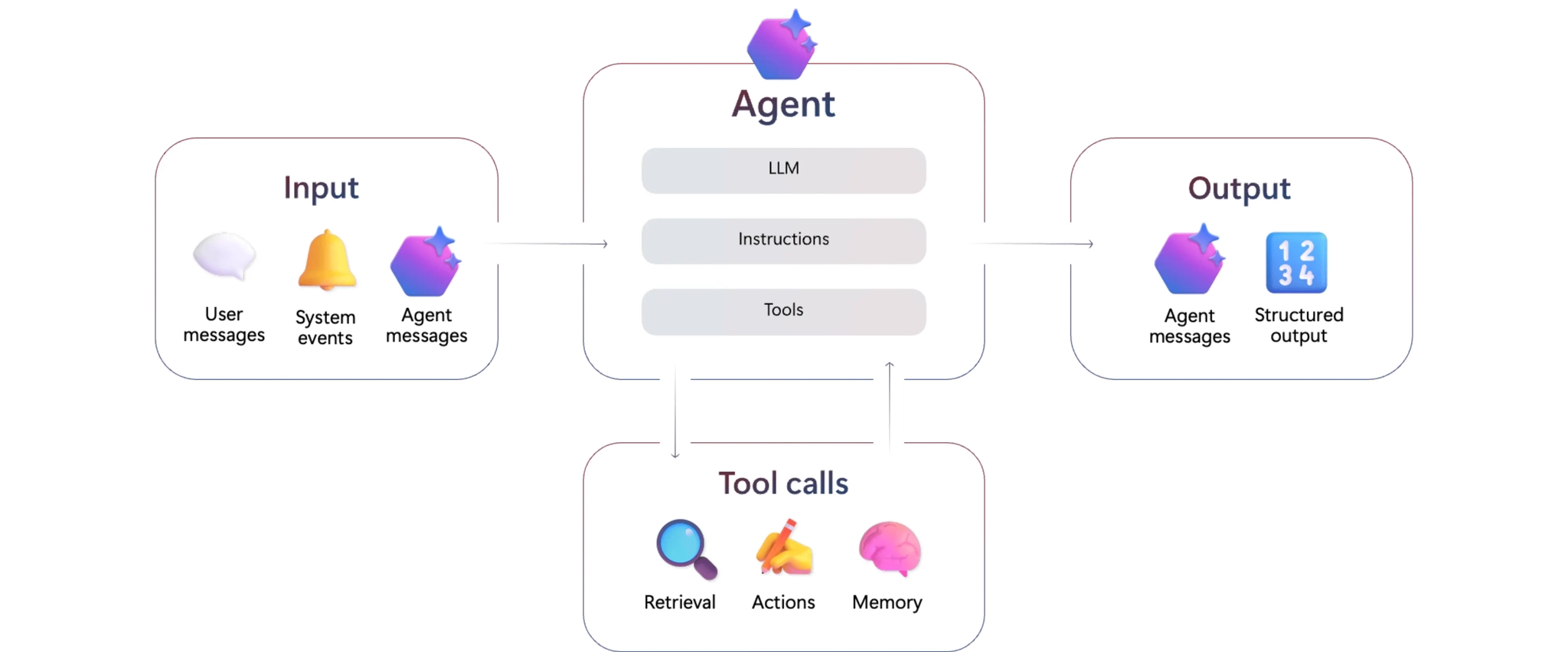

특히 AI 에이전트의 핵심 구성 요소인 모델, 도구, MCP와 '생각-동작-관찰'로 이어지는 워크플로우를 통해 실무 중심의 AI 활용법을 익혔습니다.

네 가지 기술이 섞여 있는 현재의 AI 발전 상황

AI Agent의 핵심 구성 요소

AI Agent의 워크플로우: 생각-동작-관찰의 순환을 거친 최종 답변 생성